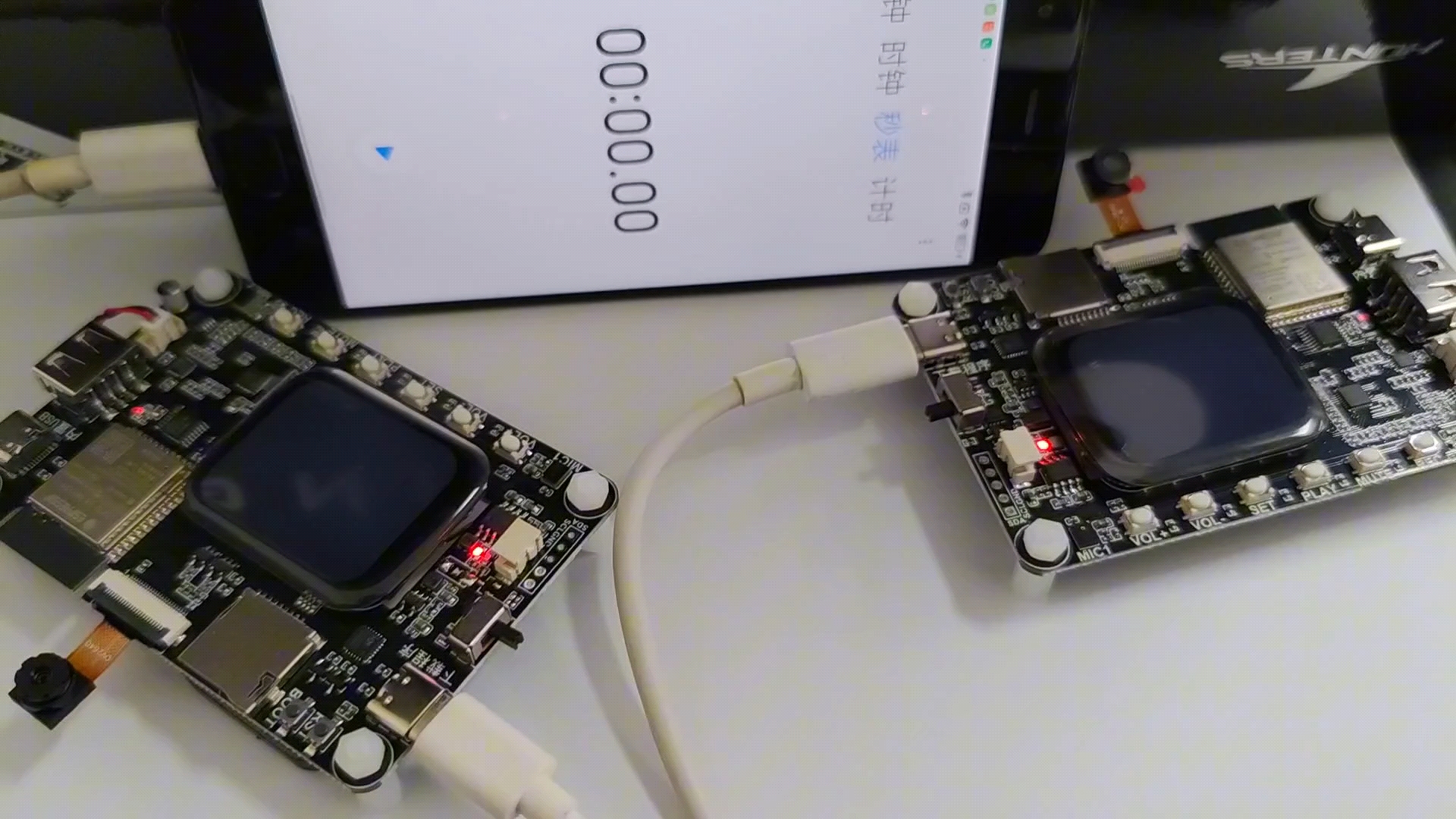

融云实时音视频SDK 会对市面上的各类智能硬件设备,特别是各种类型、各种版本的手机进行适配,以确保 SDK 的稳定性。但不同于手机的适配,智能硬件的适配有很多不同之处:

1.很多智能硬件的运行内存、CPU性能等硬件配置普遍比手机性能低;2.部分厂商在智能硬件的摄像头安装方向、个数、类型和手机有较大差异。所以在适配问题上,智能硬件需要单独进行验证讨论,下面就为大家进行详细解析。

融云实时音视频SDK 摄像头采集数据提供Texture 和 YUV(NV21) 两种方式,通过设置不同采集方式可以获取到 Texture ID 或 byte 原始视频流数据。Texture ID 用来表示图像照片或者一系列的数据,使用纹理可以使物体展现更多的细节,YUV 则是摄像头采集出的 NV21 格式数据。

YUV 是一种彩色编码格式,可以将其理解为原始视频流数据,主要用在视频、图形处理流水线中(pipeline)。相对于 RGB 颜色空间,设计 YUV 的目的就是为了编码、传输更方便,减少带宽占用和信息出错。

融云实时音视频 SDK 中默认采用 Texture 方式采集,当本端使用该方式采集时,编码器默认将使用android.media.MediaCodecInfo.CodecCapabilities.COLOR_FormatSurface(0x7F000789) 颜色空间进行编码,如果对端不支持该颜色空间的情况下,可能会导致解码花屏或者解码失败问题,开发者可以在加入房间之前调用 RongRTCConfig.Builder#enableVideoTexture 方法设置是否采用 texture 方式采集。

在遇见智能硬件摄像头安装方向、个数、类型导致的视频采集问题时,可以通过融云实时音视频SDK中 RongRTCConfig.Builder 类的设置方法 setCameraDisplayOrientation 和 setCustomizedCameraParameter,修改摄像机采集的角度和直接设置给 android.hardware.Camera#setParameters(Parameters params) 配置信息。

融云实时音视频 SDK 会通过 android.hardware.Camera.getNumberOfCameras() 方法获取到可用的摄像头 ID,默认会打开前置摄像头,对于需要打开鱼眼镜头或者搭载多个摄像头硬件设备场景中,可以使用

RongRTCCapture.getInstance().startCameraCapture 打开、切换;RongRTCCapture.getInstance().switchCamera 指定 ID 的摄像头。当智能硬件带有USB摄像头或 USB 麦克风,并且安卓系统无法识别其外置设备时,调用上文方法将无法打开硬件设备(对端将无法观看本端视频),这种情况,推荐使用融云实时音视频 SDK 发布自定义视频流功能。

二、视频编解码适配

融云音视频 SDK 支持 H.264 编解码器,以高压缩、高质量和支持多种网络的流媒体传输著称,同时也是 MPEG-4 第十部分,是由ITU-T视频编码专家组(VCEG)和ISO/IEC动态图像专家组(MPEG)联合组成的联合视频组(JVT,Joint Video Team)提出的高度压缩数字视频编解码器标准,这个标准通常被称之为H.264/AVC。

使用融云音视频 SDK 时,可以设置编码器颜色空间、编码等级、编码帧率、编码关键帧间隔时间、编码器码率控制模式等配置信息,以解决设备编解码导致的问题。

融云 RTCLib SDK 中摄像头采集数据采用的颜色格式为 NV21,它属于 YUV420 格式,如果智能硬件厂商定制了颜色空间,会导致融云 SDK 内部处理颜色空间逻辑和设备所支持颜色空间不符合,出现编码报错、对端解码失败、对端观看花屏等现象。遇见此问题,开发者可以使用 RongRTCConfig.Builder#setHardWareEncodeColor 方法修改编码颜色空间来解决。

由于视频编码后显示的数据质量偏低,为了调整质量,就需要设置编码等级 level、profile。融云 SDK 默认使用 android.media.MediaCodecInfo.CodecProfileLevel.AVCProfileBaseline ,开发者也可以通过 RongRTCConfig.Builder#enableHardWareEncodeHighProfile 方法将其设置为 android.media.MediaCodecInfo.CodecProfileLevel.AVCProfileHigh,AVCProfileHigh 所对应的编码等级为 android.media.MediaCodecInfo.CodecProfileLevel.AVCLevel3,AVCProfileHigh 相对 AVCProfileBaseline 采用了更高级的压缩特性,这意味着对端在解码时也需要硬件更高的性能,采用 AVCProfileBaseline 是因为其兼容性更高。安卓源码中 7.0 版本之前默认使用 AVCProfileBaseline ,7.0 才修改了该逻辑。

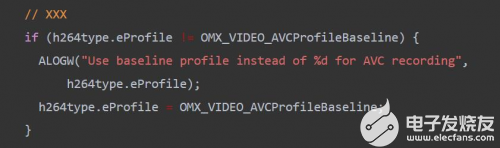

安卓 6.0 源码(android/6.0.1_r16/xref/frameworks/av/media/libstagefright/ACodec.cpp)片段如下:

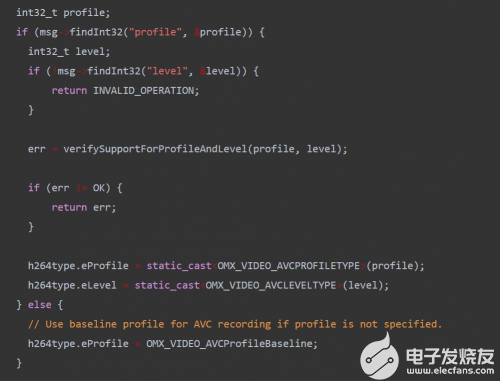

安卓 7.0 源码(android/7.0.0_r31/xref/frameworks/av/media/libstagefright/ACodec.cpp)代码片段如下:

编码码率控制模式

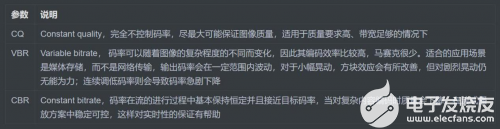

对于需要传输高质量视频流的场景,除了设置分辨率、帧率、码率提高视频质量外,还可以控制编码码率,融云 SDK 默认使用 CBR ,开发者可以使用音视频 SDK 的 RongRTCConfig.Builder#setHardWareEncodeBitrateMode 方法修改模式设置。该属性安卓 5.0 才开始支持参数设置,以下是对三种模式的介绍:

编码关键帧间隔时间

H.264 标准中有 Instantaneous Decoding Refresh(IDR,即时解码刷新,以下称 I 帧)。H.264 图像以序列为单位进行组织,一个序列是一段图像编码后的数据流,该序列以 I 帧开始,到下一个 I 帧结束。两个 I 帧之间为多个 P 帧(Predictive-frame)或 B 帧(Bi-directional predicted frames),设置的编码关键帧间隔时间就是 IDR 间隔时间。

I 帧:通常是每个 GOP(Group Of Picture) (MPEG 所使用的一种视频压缩技术) 的第一个帧,I 帧图像采用帧内编码方式,即只利用了单帧图像内的空间相关性,而没有利用时间相关性。I 帧使用帧内压缩,不使用运动补偿,由于 I 帧不依赖其它帧,所以是随机存取的入点,同时是解码的基准帧。I 帧主要用于解码器的初始化,以及节目的切换和插入,I 帧图像的压缩倍数相对较低,I 帧图像是周期性出现在图像序列中的,出现频率可由编码器选择,I 帧压缩可去掉视频的空间冗余,而 B、P 则是为了去掉时间冗余。

P 帧:向前参考帧(第一帧之后的帧,只存在和前一帧的差异,可以提高压缩效率和图像质量),压缩时只参考前一个帧,属于帧间编码方式(即同时利用了空间和时间上的相关性),P 帧图像中可以包含帧内编码的部分,即 P 帧中的每一个宏块可以是前向预测,也可以是帧内编码;它参考前一个 B 帧或 I 帧来解码出一张完整的图像。

B 帧:双向参考帧,压缩参考前一帧和后一帧,属于帧间压缩技术。压缩比高,如果网络不好,对实时要求高的话会一直等待,实时互动直播一般不使用,值得注意的是,由于 B 帧图像采用了未来帧作为参考,因此 MPEG-2 编码码流中图像帧的传输顺序和显示顺序是不同的。

因为 H.264 采用了多帧预测,所以 I 帧之后的 P帧可能会参考 I 帧之前的帧,这使得在随机访问的时候不能以找到 I 帧作为参考条件,因为即使找到了 I 帧,I 帧之后的数据也有可能解不出数据,而IDR 帧就是一种特殊的 I 帧(这一帧之后的所有参考帧只会参考IDR,而不会参考其他前面的帧)。在解码器中,一旦收到 IDR 帧,就会立即清理参考帧缓冲区,并将 IDR 帧作为被参考帧。

融云 SDK 中关键帧间隔时间默认为 100 秒,开发者可以通过 RongRTCConfig.Builder#setHardWareEncodeKeyFrameInterval 方法修改间隔时间,如果该值设置过小,会加大网络流量和编解码压力;如果过大,在网络有波动情况下,图像质量会下降。以上就是融云在实时音视频 SDK 对智能硬件视频适配方面的一些经验,希望能对开发者朋友们理解智能硬件的适配有所帮助。

fqj

- 视频

+关注

关注

6文章

1907浏览量

72428 - 智能硬件

+关注

关注

205文章

2318浏览量

107039

发布评论请先登录

相关推荐

常见音视频接口的静电浪涌防护和滤波方案

BK7256 WIFI+BLE音视频低功耗芯片 ,支持小家电驱屏,ipc、可视门锁,智能猫眼

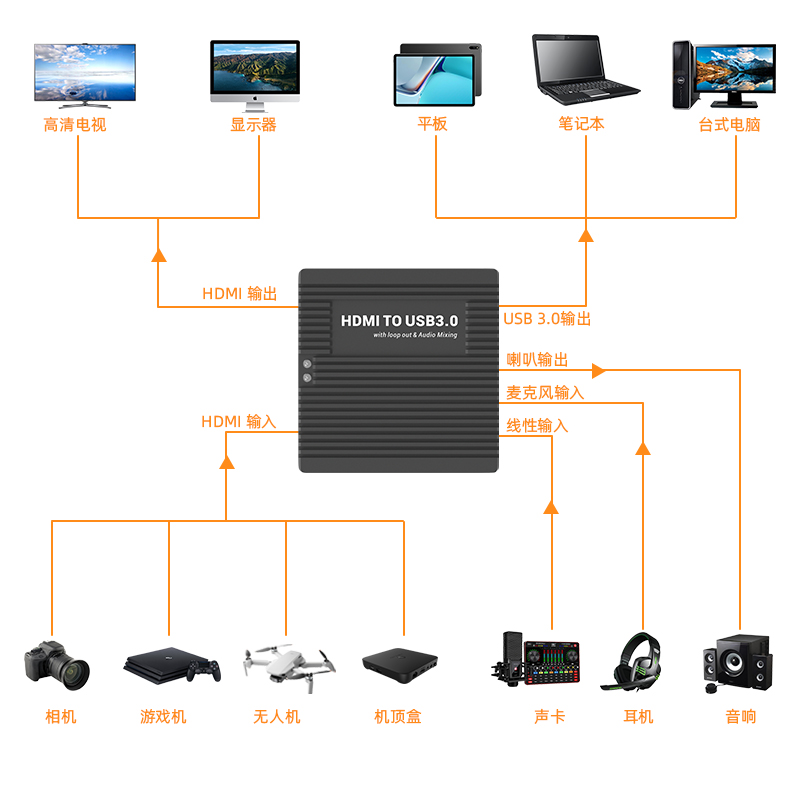

高清HDMI转USB 3.0音视频多功能音采集卡-测评

【RTC程序设计:实时音视频权威指南】音视频的编解码压缩技术

音视频SoC与AI技术融合,带来更智能的音视频处理解决方案

【RTC程序设计:实时音视频权威指南】音频采集与预处理

【RTC程序设计:实时音视频权威指南】新书一瞥

音视频解码生成:打造极致观影体验的关键技术

音视频解码生成与流媒体传输的结合

音视频

关于手机端音视频技术的思考与经验

HarmonyOS音视频开发概述

打造沉浸式专业音视频体验

关于实时音视频SDK对智能硬件的视频适配

关于实时音视频SDK对智能硬件的视频适配

评论