本文首发于公众号【调皮连续波】,其他平台为自动同步,内容若不全或乱码,请前往公众号阅读。保持关注调皮哥,和1.5W雷达er一起学习雷达技术!

【正文】

编辑|雷达小助理 审核|调皮哥

早在今年(2023年)的上海国际汽车展会上,采埃孚(ZF)官方宣布将重磅推出4D成像雷达开发环境和带标注的数据集,这是采埃孚首次将4D成像毫米波雷达开发环境和数据集向客户开放,也是目前大家最具期待的4D成像毫米波雷达数据集之一。

随着采埃孚数万公里数据集的开放,将会补充现阶段世界上4D成像毫米波雷达数据集的不足之处,更能够帮助实现更好的信息共享与自动驾驶技术升级,全面提升用户的差异化竞争力。

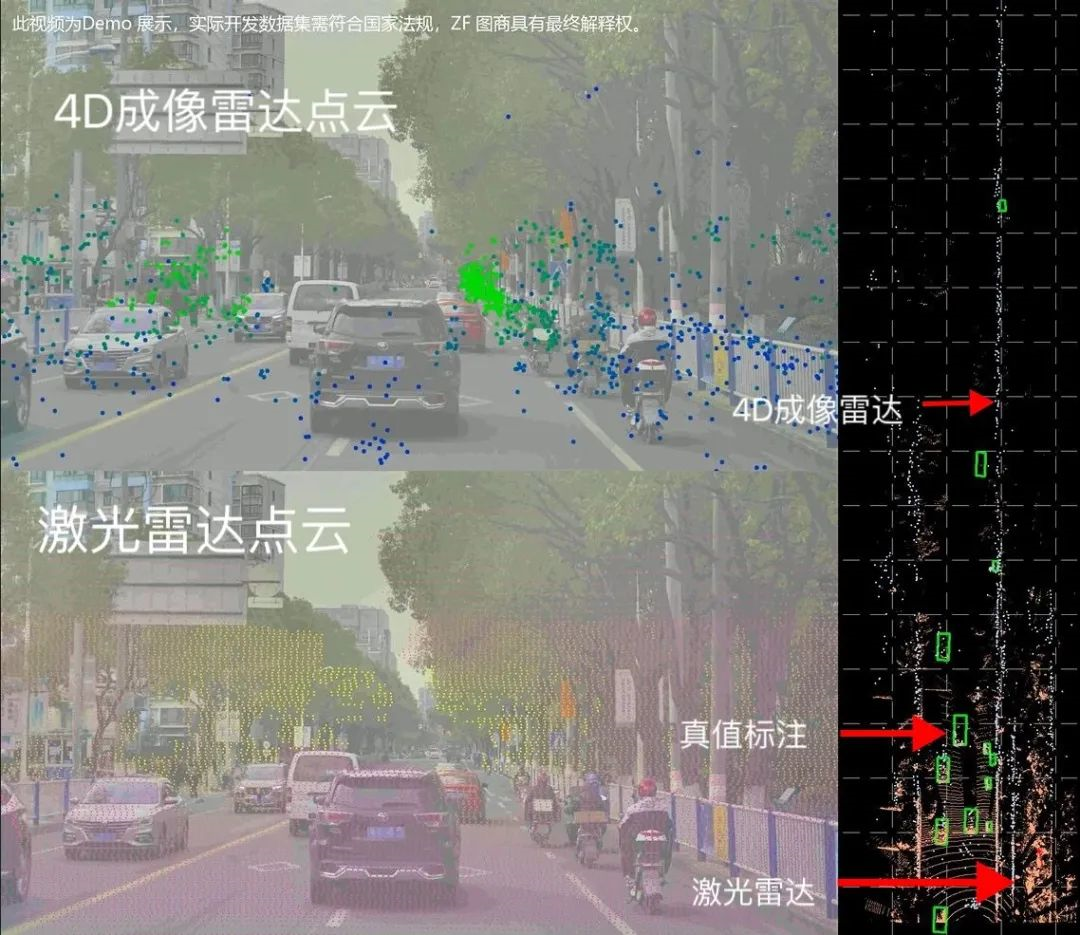

[图片来源:采埃孚官微]

采埃孚宣称其4D成像毫米波雷达数据集是带标注的公开数据集,包括雷达的真实点云数据及激光雷达标注数据。数据集中的标准参照标注信息(Ground Truth Label)采用清晰度更高的激光雷达为基准进行打标,从而验证4D成像毫米波雷达的准确性和可靠性。

这些数据集将展示4D成像毫米波雷达探测的准确性及可应用场景,从而帮助用户形成相关概念,加速其应用4D成像毫米波雷达的进程,同时可基于该数据集信息,研究人员可以根据自己的算法扩展新的功能。

这份由采埃孚(ZF)提供用于自动驾驶目标检测的4D成像毫米波雷达数据集,采用的是采埃孚的FRGen21 4D成像毫米波雷达捕获的,已经在Github中发布了存储库,链接如下:

https://github.com/ZF4DRadSet/ZF-4DRadar-Dataset。

目前,由于相关政策原因,暂时还没有发布正式的数据集,但预计今年会发布,敬请期待。

在此之前,调皮连续波公众号平台分享过View-of-Delft (VOD)4D成像毫米波雷达数据集,同样采用了采埃孚的 FRGen21 3+1D 雷达捕获数据,如下链接所示:

1、雷达开源数据集 | 代尔夫特数据集(VOD),4D雷达、激光雷达和相机数据

2、4D成像毫米波雷达点云数据集VOD(含Python和MATLAB数据解析仿真代码)

FRGen21雷达捕获的4D成像毫米波雷达数据集和VOD数据集不同,该数据集包含了7000帧4D成像毫米波数据,同时相机和激光雷达数据也同步收集和校准。

该数据集的场景包括 4 个典型场景:城市综合体交通场景、停车场场景、隧道场景、高速公路场景,总的来说场景要比VOD数据更加完整,VOD仅有城市综合体交通场景。目标检测的类别包括四类:汽车、自行车、行人和卡车/巴士。

采用该数据集,可以在四个维度(范围,速度,方位角和仰角)中提供了很高的探测性能,可以覆盖最远200m的物体。数据的注释格式与kitti数据集类似,包含多传感器的时间戳、校准参数、目标检测的类别以及检测边界框的位置和大小。

同时,将包含 7000 帧的数据集分别分为 5000 帧的训练集、1000 帧的验证集和测试集。如前所示,作为初步的学习和研究,这十分有利于读者进行学习和验证相关的算法,从而不需要花费大量时间在数据标注上。

今年7月份也将会开放申请到同济大学数据集,链接如下:

https://github.com/TJRadarLab/TJ4DRadSet

TJ4DRadSet:自动驾驶4D成像雷达数据集演示效果:

届时,这两个4D成像毫米波雷达数据集,加上VOD数据集,以及之前的众多雷达数据集。宏观上讲,将会越加丰富雷达感知与自动驾驶的研究,促进行业发展;从微观上讲,将会给大家提供更多的研究帮助,促进个人学术研究!

非常感谢诸多科学家、工程师,技术人员,企业、高校以及研究所给行业带来的宝贵资源!

【本期结束】

【点击以下链接可直达各个业务模块】

| 加入年度会员(专属VIP群) | |

本文是空闲时个人的心得体会,仅供参考。目前我还有很多内容需要学习,如果还有没有说到或者不全面的地方,还请指正,感谢大家。喜欢本文,可以一键三连。欢迎关注备用号【跳频连续波】。

审核编辑黄宇

-

自动驾驶

+关注

关注

784文章

13784浏览量

166382 -

毫米波雷达

+关注

关注

107文章

1043浏览量

64342

发布评论请先 登录

相关推荐

英飞凌与采埃孚合作优化自动驾驶软件

正和微芯发布4D毫米波雷达SoC芯片RS6240

恩智浦展示汽车毫米波雷达最新解决方案

行易道与韩国自动驾驶公司签署技术开发协议

未来已来,多传感器融合感知是自动驾驶破局的关键

采埃孚中国荣获上海L4级自动驾驶测试牌照

经纬恒润4D成像毫米波雷达亮相 CES 2024

最新 | 采埃孚(ZF)自动驾驶4D成像毫米波雷达数据集

最新 | 采埃孚(ZF)自动驾驶4D成像毫米波雷达数据集

评论