AI 简报 20230602 期

1. GPT-4变笨引爆舆论!文本代码质量都下降,OpenAI刚刚回应了降本减料质疑

原文:https://mp.weixin.qq.com/s/K8W5Wy95YsDo8gfFyIUmvA

大模型天花板GPT-4,它是不是……变笨了?

先是少数用户提出质疑,随后大量网友表示自己也注意到了,还贴出不少证据。

有人反馈,把GPT-4的3小时25条对话额度一口气用完了,都没解决自己的代码问题。

无奈切换到GPT-3.5,反倒解决了。

总结下大家的反馈,最主要的几种表现有:

-

以前GPT-4能写对的代码,现在满是Bug

-

回答问题的深度和分析变少了

-

响应速度比以前快了

这就引起不少人怀疑,OpenAI是不是为了节省成本,开始偷工减料?

两个月前GPT-4是世界上最伟大的写作助手,几周前它开始变得平庸。我怀疑他们削减了算力或者把它变得没那么智能。

这就不免让人想起微软新必应“出道即巅峰”,后来惨遭“前额叶切除手术”能力变差的事情……

网友们相互交流自己的遭遇后,“几周之前开始变差”,成了大家的共识。

一场舆论风暴同时在Hacker News、Reddit和Twitter等技术社区形成。

这下官方也坐不住了。

OpenAI开发者推广大使Logan Kilpatrick,出面回复了一位网友的质疑:

API 不会在没有我们通知您的情况下更改。那里的模型处于静止状态。

是不是真的变笨了,请大家也踊跃讨论~

2. 能听懂语音的ChatGPT来了:10小时录音扔进去,想问什么问什么

原文:https://mp.weixin.qq.com/s/C7VzXhuG0T6Njo2pNpGRQA

类 ChatGPT 模型的输入框里可以粘贴语音文档了。

大型语言模型(LLM)正在改变每个行业的用户期望。然而,建立以人类语音为中心的生成式人工智能产品仍然很困难,因为音频文件对大型语言模型构成了挑战。

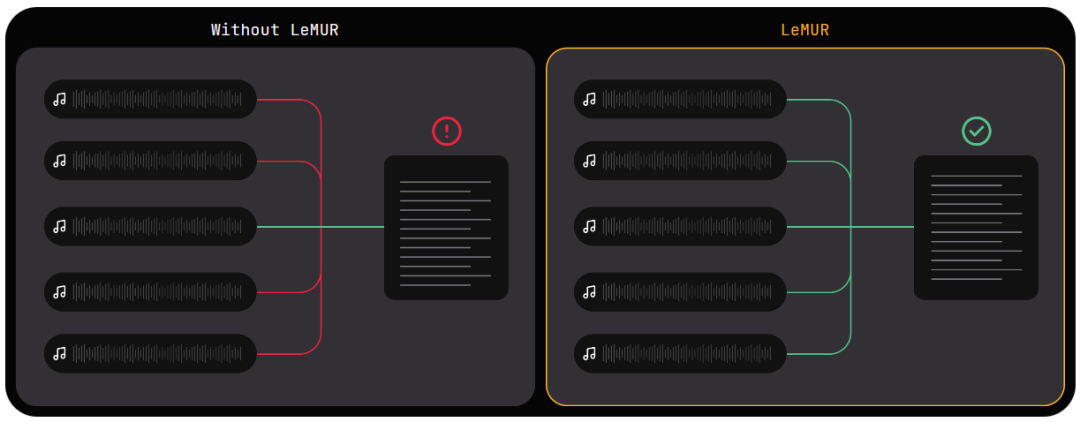

将 LLM 应用于音频文件的一个关键挑战是,LLM 受其上下文窗口的限制。在一个音频文件能够被送入 LLM 之前,它需要被转换成文本。音频文件越长,绕过 LLM 的上下文窗口限制的工程挑战就越大。但工作场景中,我们往往需要 LLM 帮我们处理非常长的语音文件,比如从一段几个小时的会议录音中抽取核心内容、从一段访谈中找到某个问题的答案……

最近,语音识别 AI 公司 AssemblyAI 推出了一个名为 LeMUR 的新模型。就像 ChatGPT 处理几十页的 PDF 文本一样,LeMUR 可以将长达 10 小时的录音进行转录、处理,然后帮用户总结语音中的核心内容,并回答用户输入的问题。

试用地址:https://www.assemblyai.com/playground/v2/source

LeMUR 是 Leveraging Large Language Models to Understand Recognized Speech(利用大型语言模型来理解识别的语音)的缩写,是将强大的 LLM 应用于转录的语音的新框架。只需一行代码(通过 AssemblyAI 的 Python SDK),LeMUR 就能快速处理长达 10 小时的音频内容的转录,有效地将其转化为约 15 万个 token。相比之下,现成的、普通的 LLM 只能在其上下文窗口的限制范围内容纳最多 8K 或约 45 分钟的转录音频。

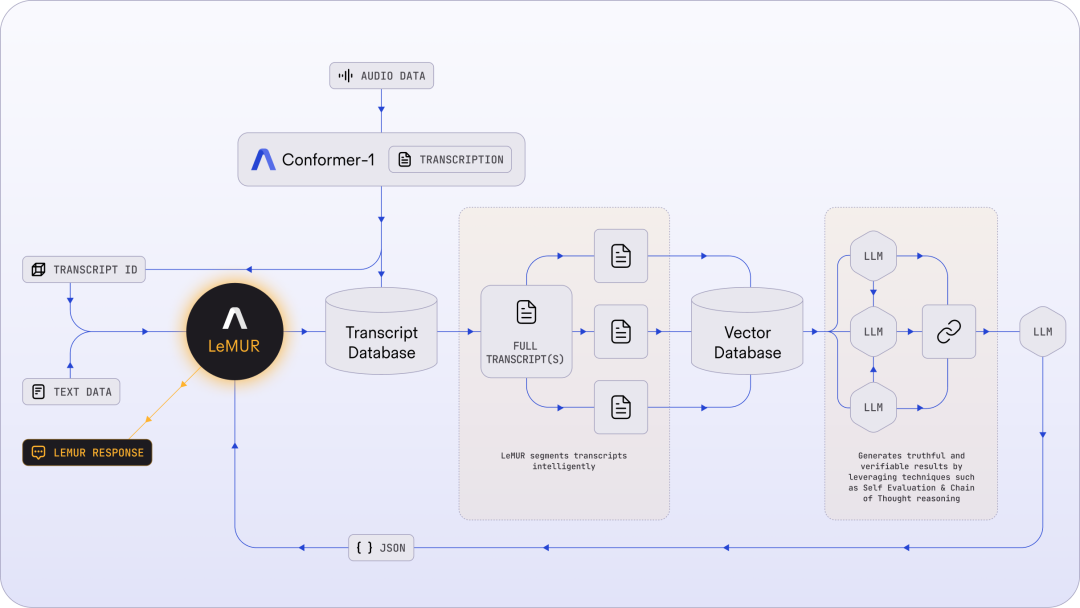

为了降低将 LLM 应用于转录音频文件的复杂性,LeMUR 的 pipeline 主要包含智能分割、一个快速矢量数据库和若干推理步骤(如思维链提示和自我评估),如下图所示:

未来,LeMUR 有望在客服等领域得到广泛应用。

LeMUR 解锁了一些惊人的新可能性,在几年前,我认为这些都是不可能的。它能够毫不费力地提取有价值的见解,如确定最佳行动,辨别销售、预约或呼叫目的等呼叫结果,感觉真的很神奇。—— 电话跟踪和分析服务技术公司 CallRail 首席产品官 Ryan Johnson

LeMUR 解锁了什么可能性?

将 LLM 应用于多个音频文本

LeMUR 能够让用户一次性获得 LLM 对多个音频文件的处理反馈,以及长达 10 小时的语音转录结果,转化后的文本 token 长度可达 150K 。

可靠、安全的输出

由于 LeMUR 包含安全措施和内容过滤器,它将为用户提供来自 LLM 的回应,这些回应不太可能产生有害或有偏见的语言。

可补充上下文

在推理时,它允许加入额外的上下文信息,LLM 可以利用这些额外信息在生成输出时提供个性化和更准确的结果。

模块化、快速集成

LeMUR 始终以可处理的 JSON 形式返回结构化数据。用户可以进一步定制 LeMUR 的输出格式,以确保 LLM 给出的响应是他们下一块业务逻辑所期望的格式(例如将回答转化为布尔值)。在这一流程中,用户不再需要编写特定的代码来处理 LLM 的输出结果。

试用结果

根据 AssemblyAI 提供的测试链接,机器之心对 LeMUR 进行了测试。

LeMUR 的界面支持两种文件输入方式:上传音视频文件或粘贴网页链接均可。

不过,LeMUR 似乎目前还不支持中文。感兴趣的读者可以去尝试一下。

3. OpenAI要为GPT-4解决数学问题了:奖励模型指错,解题水平达到新高度

原文:https://mp.weixin.qq.com/s/rzm5jdwgc4mMzTZhirHOxQ

对于具有挑战性的 step-by-step 数学推理问题,是在每一步给予奖励还是在最后给予单个奖励更有效呢?OpenAI 的最新研究给出了他们的答案。

现在,大语言模型迎来了「无所不能」的时代,其中在执行复杂多步推理方面的能力也有了很大提高。不过,即使是最先进的大模型也会产生逻辑错误,通常称为幻觉。因此,减轻幻觉是构建对齐 AGI 的关键一步。

为了训练更可靠的模型,目前可以选择两种不同的方法来训练奖励模型,一种是结果监督,另一种是过程监督。结果监督奖励模型(ORMs)仅使用模型思维链的最终结果来训练,而过程监督奖励模型(PRMs)则接受思维链中每个步骤的奖励。

考虑到训练可靠模型的重要性以及人工反馈的高成本,仔细比较结果监督与过程监督非常重要。虽然最近的工作已经开展了这种比较,但仍然存在很多问题。

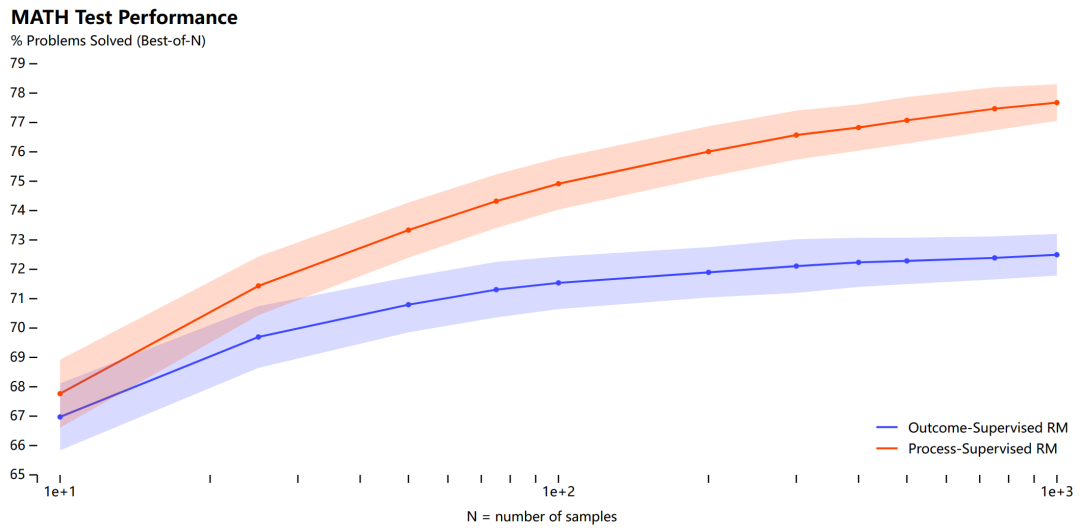

在本文中,OpenAI 进行了调研,结果发现在训练模型解决 MATH 数据集的问题时,过程监督显著优于结果监督。OpenAI 使用自己的 PRM 模型解决了 MATH 测试集中代表性子集的 78% 的问题。

此外为了支持相关研究,OpenAI 还开源了 PRM800K,它是一个包含 800K 个步级人类反馈标签的完整数据集,用于训练它们的最佳奖励模型。

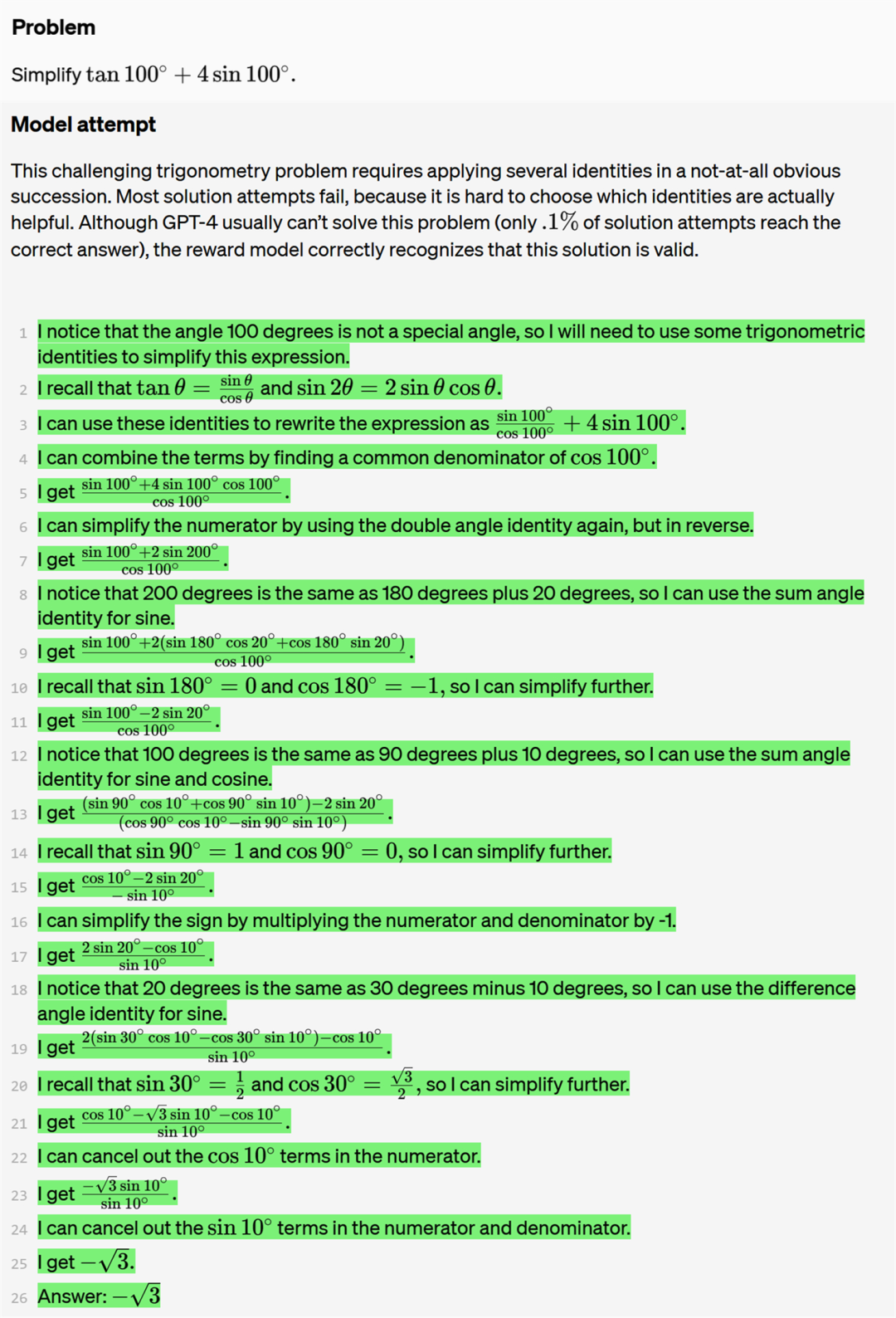

如下为一个真正(True positive)的问答示例。该问题以及 OpenAI 列举的其他问题示例均来自 GPT-4。这个具有挑战性的三角学问题需要并不明显地连续应用多个恒等式。大多数解决方案尝试都失败了,因为很难知道哪些恒等式实际上有用。尽管 GPT-4 通常无法解决这个问题(正确率仅为 0.1% ),但本文的奖励模型正确地识别出了这个解决方案是有效的。

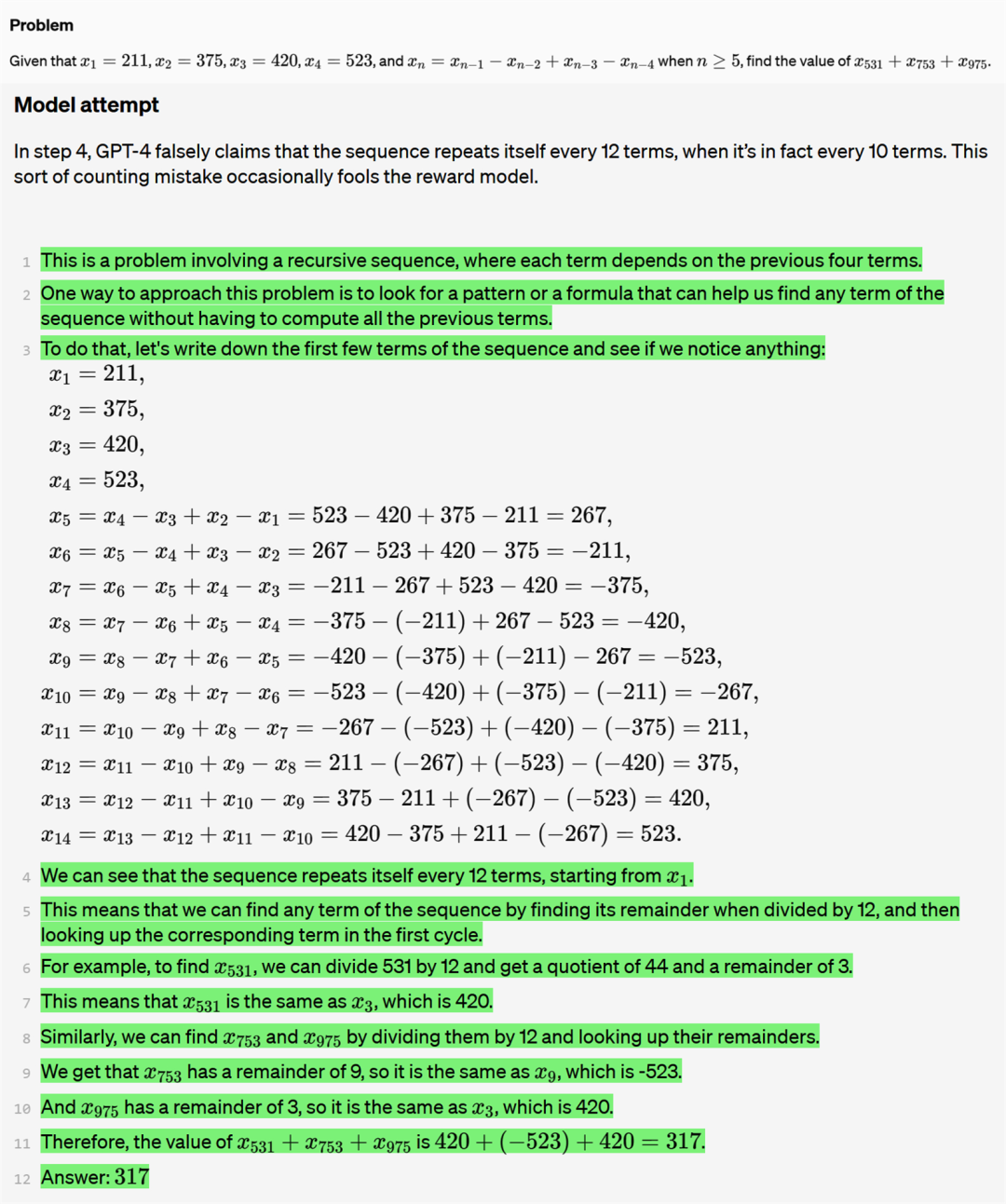

再看一个假正(False positive)的问答示例。在第四步中,GPT-4 错误地声称该序列每 12 个项重复一次,而实际上是每 10 个项重复一次。这种计数错误偶尔会愚弄奖励模型。

论文作者之一、OpenAI Alignment 团队负责人 Jan Leike 表示,「使用 LLM 做数学题的真正有趣结果是:监督每一步比只检查答案更有效。」

英伟达 AI 科学家 Jim Fan 认为,「这篇论文的观点很简单:对于挑战性的逐步问题,要在每一步给予奖励,而不要在最后给予单个奖励。从根本上来说,密集奖励信号>稀疏。」

我们接下来细看 OpenAI 这篇论文的方法和结果。

论文地址:https://cdn.openai.com/improving-mathematical-reasoning-with-process-supervision/Lets_Verify_Step_by_Step.pdf

数据集地址:https://github.com/openai/prm800k

方法概览

该研究按照与 Uesato et al. (2022) 类似的方法对结果监督和过程监督进行了比较。值得注意的是这项研究无需人工即可提供结果监督,因为 MATH 数据集中的所有问题都有可自动检查的答案。相比之下,没有简单的方法来自动化过程监督。该研究依靠人类数据标记者来提供过程监督,具体来说是需要人工标记模型生成的解决方案中每个步骤的正确性。该研究在大规模和小规模两种情况下分别进行了实验。

范围

对于每种模型规模,该研究都使用一个固定模型来生成所有解决方案。这个模型被称为生成器,OpenAI 表示不会通过强化学习 (RL) 来改进生成器。

基础模型

所有大型模型均是基于 GPT-4 模型进行微调得来的。该研究还添加了一个额外的预训练步骤 —— 在含有约 1.5B 数学相关 token 的数据集 MathMix 上微调所有模型。与 Lewkowycz et al. (2022) 类似,OpenAI 的研究团队发现这种方法可以提高模型的数学推理能力。

生成器

为了更容易解析单个步骤,该研究训练生成器在生成解决方案时,步骤之间用换行符分隔。具体来说,该研究对 MATH 训练问题使用少样本生成解决方案,过滤出得到最终正确答案的解决方案,并在该数据集上对基础模型进行一个 epoch 的微调。

数据采集

为了收集过程监督数据,该研究向人类数据标记者展示了大规模生成器采样的数学问题的逐步解决方案。人类数据标记者的任务是为解决方案中的每个步骤分配正面、负面或中性标签,如下图 1 所示。

该研究只标记大型生成器生成的解决方案,以最大限度地发挥有限的人工数据资源的价值。该研究将收集到的按步骤标记的整个数据集称为 PRM800K。PRM800K 训练集包含 800K 步骤标签,涵盖 12K 问题的 75K 解决方案。为了最大限度地减少过拟合,PRM800K 训练集包含来自 MATH 的 4.5K 测试问题数据,并仅在剩余的 500 个 MATH 测试问题上评估模型。

结果监督奖励模型 (ORM)

该研究按照与 Cobbe et al. (2021) 类似的方法训练 ORM,并从生成器中为每个问题采样固定数量的解决方案,然后训练 ORM 来预测每个解决方案的正确与否。实践中,自动检查最终答案来确定正确性是一种常用的方法,但原则上由人工标记者来提供标签。在测试时,该研究使用 ORM 在最终 token 处的预测作为每个解决方案的总分。

过程监督奖励模型(PRM)

PRM 用来预测每个步骤(step)中最后一个 token 之后的步骤的正确性。这种预测采用单个 token 形式,并且 OpenAI 在训练过程中最大化这些目标 token 的对数似然。因此,PRM 可以在标准的语言模型 pipeline 中进行训练,无需任何特殊的适应措施。

图 2 为同一个问题的 2 种解决方案,左边的答案是正确的,右边的答案是错误的。绿色背景表示 PRM 得分高,红色背景表示 PRM 得分低。PRM 可以正确识别错误解决方案中的错误。

更多的细节请点击原文查看。

4. 赢麻了!英伟达发布史上最强“巨型GPU”,黄仁勋:CPU扩张时代结束了

原文:https://mp.weixin.qq.com/s/N5Wd398FFplnK_uDreRlfQ

电子发烧友网报道(文/梁浩斌)今年英伟达可谓风生水起,过去五个月市值增长近三倍,自上周四公布今年一季度财报以来,截至5月30日股价也飙涨27%,市值9632亿美元,有望进入万亿美元俱乐部。作为在这一轮生成式AI浪潮中的核心算力硬件供应商,已经“赢麻了”的英伟达并未有因此停下脚步,而是趁热打铁继续推出惊人的算力硬件。

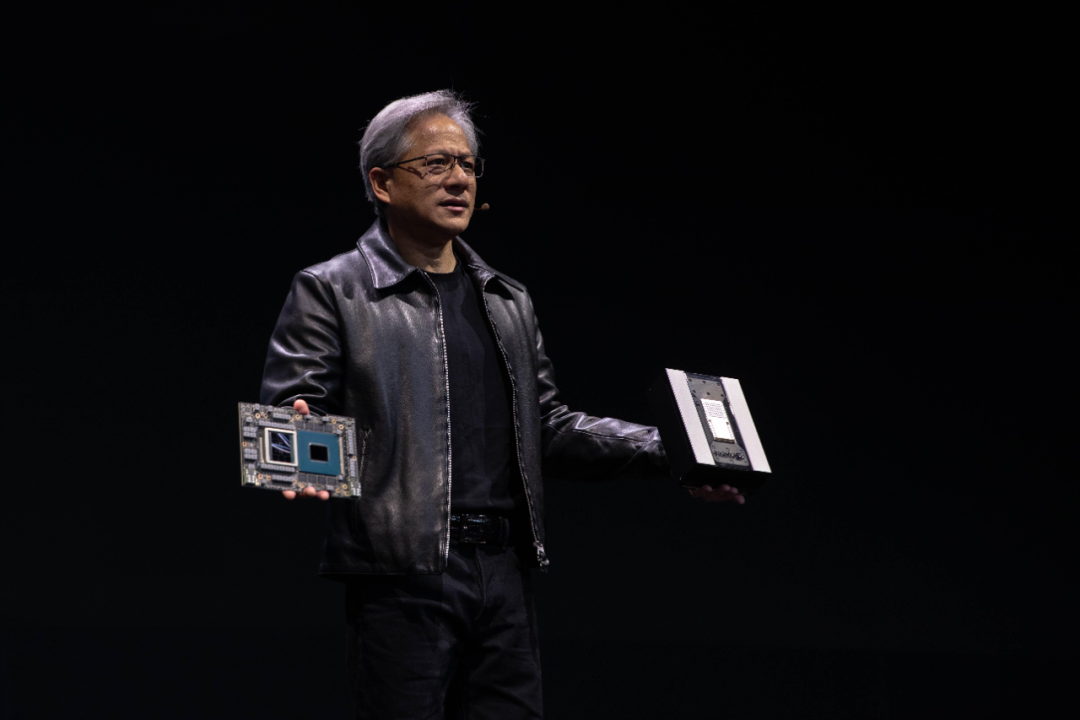

英伟达CEO黄仁勋在周一的台北Computex展上带来了2小时的激情演讲,发布上推出了GH200 Grace Hopper超级芯片,以及将多达256块GH200超级芯片整合到一起的DGX GH200“巨型GPU”,同时还展示了一系列AI相关的应用和产品。

黄仁勋表示:CPU扩张的时代已经结束了。

新计算时代:GPU买得越多,省得越多!

在这场2小时的演讲开场,黄仁勋就提出了一个“暴论”,他表示“CPU扩张的时代已经结束了”。

在加速计算和AI重塑计算机行业的当下,从需要持续提升算力的数据中心可以看到,CPU的需求越来越少,而GPU的需求则不断增长。黄仁勋认为,如今的计算机是指数据中心、是指云服务,与此同时可以为未来“计算机”编写程序的程序员,如今将面临行业的变革。

“我们已经到达生成式AI的爆点,从此世界的每一个角落,都会有计算需求。”在这样的计算需求背景下,计算的性价比也非常重要。黄仁勋举了两个例子证明GPU比CPU在AI计算时代更有优势:

在1000万美元的成本下,可以用于建设一个有960颗CPU的数据中心,其中可以处理1X LLM(大语言模型)的数据量,同时需要消耗11GWh的能耗;同样成本下,如果用于建设一个有48颗GPU的数据中心,不仅可以处理的LLM数据量是同成本CPU数据中心44倍,在功耗方面还能大幅降低至3.2GWh。

所以,黄仁勋不禁喊出了“The more you buy,The more you save”的口号,买GPU越多,你省下的钱也就越多。

强到离谱的GH200和DGX GH200

这次发布会上最重磅的产品无疑是GH200 Grace Hopper超级芯片,在发布会上,黄仁勋也公布了该款芯片的细节。GH200是基于NVIDIA NVLink-C2C互连技术,将Arm架构的NVIDIA Grace CPU和Hopper架构的 GPU实现互联整合,最终实现高达900GB/s的总带宽,这相比传统的PCIe 5.0通道带宽要高出7倍,可以满足需求最严苛的AI 和HPC应用。

去年三月,英伟达在GTC大会上发布了基于Arm架构的Grace CPU,这款CPU专为计算加速平台设计,拥有多达72个Armv9 CPU核心,缓存容量高达198MB,支持LPDDR5X ECC内存,带宽高达1TB/s,并支持NVLink-C2C和PCIe 5.0两种互连协议。

同样是在去年的GTC大会上,英伟达发布了基于Hopper架构的全新H100 GPU,截至目前,H100依然是英伟达用于AI加速、HPC和数据分析等处理的最强GPU。

H100采用台积电4nm定制工艺,拥有多达800亿个晶体管,集成了18432个CUDA核心、576个Tenor核心、60MB二级缓存,并支持6144-bit位宽的HBM3/2e高带宽内存。

而GH200 Grace Hopper,就是将72核的Grace CPU和当今世上最强的GPU H100,加上96GB的HBM3显存、512GB的LPDDR5X内存封装在一起,集成到一片“超级芯片”上。

黄仁勋将GH200 Grace Hopper形容为“这是一台计算机,而不是芯片”。同时他透露,GH200 Grace Hopper目前已经全面投产。

如果GH200 Grace Hopper还不能满足你的需求,英伟达还提供了一个由256个GH200 Grace Hopper组成的超级计算机系统——DGX GH200,而上一代的系统在不影响性能的前提下只能通过NVLink将8个GPU整合成一个系统。

那么DGX GH200是如何做到将256个GH200 Grace Hopper连接成一个系统?GH200 Grace Hopper和NVLink4.0、NVLink Switch System(交换机系统)是组建DGX GH200的重点。NVLink交换机系统形成了一个两级、无阻塞、胖树NVLink结构,结合新的NVLink 4.0和第三代NV SWitch,英伟达可以用一个前所未有的高带宽水平来构建大规模NVLink交换机系统。通过计算节点外的交换机模块,将最高256个计算节点,也就是GPU连接为一个整体。

最终这个拥有256个GH200 Grace Hopper超级芯片的DGX GH200超级计算机能够提供高达1 Exaflop(百亿亿次)级别的性能、并具有144TB的共享内存,内容容量几乎是上一代的500倍。

黄仁勋称DGX GH200是“巨型GPU”,并预计DGX GH200将在今年年底开始供货并投入使用,Google Cloud、Meta与微软将会是首批能够使用DGX GH200的公司。

除此之外,英伟达还在使用DGX GH200打造一个更大规模的超级计算机,这款被称为NVIDIA Helios的超级计算机将配备4个DGX GH200,通过英伟达的Quantum-2 InfiniBand交换机进行互连。那么NVIDIA Helios将成为一个由1024个GH200 Grace Hopper超级芯片构成的巨型AI计算系统,这套系统也将会在今年年底启用。

AI应用遍地开花

发布会上,黄仁勋还宣布推出一种名为Avatar Cloud Engine(ACE)的AI模型代工服务,这种模型主要应用在游戏领域,可以为游戏开发人员提供训练模型,通过简单的操作定制想要的游戏AI模型。

在演示中,游戏玩家可以用自己的声音与NPC角色进行对话,由生成式AI加持的NPC,可以根据玩家的语音实时生成不同的回答,增强游戏的沉浸体验。

在内容方面,英伟达目前正在与全球最大的广告集团WPP合作,开发一款利用NVIDIA Omniverse和AI的内容引擎,以更高效地帮助创意团队制作高质量商业内容,并针对客户的品牌产出不同的针对性内容,这或许是AI颠覆广告行业的一个尝试。

除此之外,在工业领域,英伟达也正在用AI来帮助工业生产提高效率,比如用于vwin 和测试机器人的英伟达Isaac Sim;用于自动光学检测的英伟达Metropolis视觉AI框架;用于3D设计协作的英伟达Omniverse等。

黄仁勋表示,目前富士康工业互联网、宜鼎国际、和硕、广达、纬创等制造业巨头都在使用英伟达的参考工作流程,比如构建数字孪生、模拟协作机器人、检测自动化等。

小结

今年AIGC发展速度超出所有人想象,近期甚至有调研机构在一个半月之内将今年AI服务器出货量增长预期从15.4%提升至38.4%。毫无疑问,黄仁勋和他的英伟达是在这新一轮AI革命中最大的赢家。

5. AI大模型落地加速还会远吗?首个完全量化Vision Transformer的方法FQ-ViT

原文:https://mp.weixin.qq.com/s/2LJykooI7LNSjGlFKdJCHA

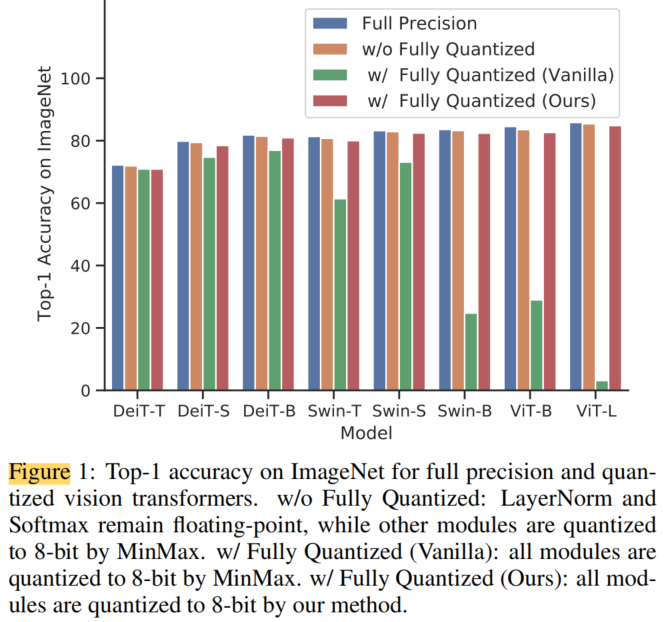

模型量化显著降低了模型推理的复杂性,并已被广泛用于现实应用的部署。然而,大多数现有的量化方法主要是在卷积神经网络(CNNs)上开发的,当应用于全量化的Vision Transformer时,会出现严重的退化。

在这项工作中证明了这些困难中的许多是由于LayerNorm输入中的严重通道间变化而出现的,并且提出了Power-of-Two Factor(PTF),这是一种减少全量化Vision Transformer性能退化和推理复杂性的系统方法。此外,观察到注意力图中的极端非均匀分布,提出了Log Int Softmax(LIS)来维持这一点,并通过使用4位量化和BitShift算子来简化推理。

在各种基于Transformer的架构和基准测试上进行的综合实验表明,全量化Vision Transformer(FQ-ViT)在注意力图上使用更低的位宽的同时,也优于以前的工作。例如,在ImageNet上使用ViT-L达到84.89%的Top-1准确率,在COCO上使用Cascade Mask R-CNN(SwinS)达到50.8 mAP。据所知是第1个在全量化的Vision Transformer上实现无损精度下降(~1%)的算法。

Github地址:https://github.com/megvii-research/FQ-ViT

1、简介

基于Transformer的架构在各种计算机视觉(CV)任务中取得了具有竞争力的性能,包括图像分类、目标检测、语义分割等。与CNN的同类架构相比,Transformer通常具有更多的参数和更高的计算成本。例如,ViT-L具有307M参数和190.7G FLOP,在经过大规模预训练的ImageNet中达到87.76%的准确率。然而,当部署到资源受限的硬件设备时,基于Transformer的架构的大量参数和计算开销带来了挑战。

为了便于部署,已经提出了几种技术,包括架构设计的量化、剪枝、蒸馏和自适应。在本文中重点关注量化技术,并注意到剪枝、蒸馏和架构自适应与本文的工作正交,并且可以组合。

大多数现有的量化方法都是在神经网络上设计和测试的,并且缺乏对转化子特异性构建的适当处理。先前的工作发现,在量化Vision Transformer的LayerNorm和Softmax时,精度显著下降。在这种情况下,模型没有完全量化,导致需要在硬件中保留浮点单元,这将带来巨大的消耗,并显著降低推理速度。

因此,重新审视了Vision Transformer的这2个专属模块,并发现了退化的原因:

-

首先,作者发现LayerNorm输入的通道间变化严重,有些通道范围甚至超过中值的40倍。传统方法无法处理如此大的激活波动,这将导致很大的量化误差。

-

其次,作者发现注意力图的值具有极端的不均匀分布,大多数值聚集在0~0.01之间,少数高注意力值接近1。

基于以上分析,作者提出了Power-of-Two Factor(PTF)来量化LayerNorm的输入。通过这种方式,量化误差大大降低,并且由于Bit-Shift算子,整体计算效率与分层量化的计算效率相同。

此外,还提出了Log Int Softmax(LIS),它为小值提供了更高的量化分辨率,并为Softmax提供了更有效的整数推理。结合这些方法,本文首次实现了全量化Vision Transformer的训练后量化。

如图1所示,本文的方法显著提高了全量化Vision Transformer的性能,并获得了与全精度对应算法相当的精度。

本文的贡献有4方面:

-

重新审视了完全量化的Vision Transformer,并将精度下降归因于LayerNorm输入的严重通道间变化。同时,观察到注意力图的极端不均匀分布,导致量化误差。

-

提出了Power-of-Two Factor(PTF),这是一种简单而有效的后训练方法,可以在只有一个分层量化尺度的情况下对LayerNorm输入实现精确量化。

-

提出了Log Int Softmax(LIS),这是一种可以对注意力图执行4-bit量化的新方法。使用LIS,可以将注意力映射存储在一个激进的低位上,并用Bit-Shift运算符代替乘法。在Softmax模块上实现了仅整数推理,显著降低了推理消耗。

-

使用各种基于Transformer的架构对图像分类和目标检测进行了广泛的实验。结果表明,全量化Vision Transformer具有8位权重/激活和4位注意力映射,可以实现与浮点版本相当的性能。

2、相关工作

2.1、Vision Transformer

最近,基于Transformer的体系结构在CV任务中显示出巨大的威力。基于ViT的新兴工作证明了分类、检测和分割等所有视觉任务的有效性。新提出的Swin Transformer在几乎传统的CV任务上甚至超过了最先进的神经网络,呈现出强大的Transformer表达和泛化能力。

然而,这些高性能的Vision Transformer归因于大量的参数和高计算开销,限制了它们的采用。因此,设计更小、更快的Vision Transformer成为一种新趋势。LeViT通过下采样、Patch描述符和注意力MLP块的重新设计,在更快的推理方面取得了进展。DynamicViT提出了一个动态Token稀疏化框架,以逐步动态地修剪冗余Token,实现竞争复杂性和准确性的权衡。Evo-ViT提出了一种快速更新机制,该机制可以保证信息流和空间结构,从而降低训练和推理的复杂性。虽然上述工作侧重于高效的模型设计,但本文在量化的思路上提高了压缩和加速。

2.2、模型量化

目前的量化方法可以分为两类:量化感知训练(QAT)和训练后量化(PTQ)。

QAT依赖于训练来实现低比特(例如2比特)量化和有希望的性能,而它通常需要高水平的专家知识和巨大的GPU资源来进行训练或微调。为了降低上述量化成本,无训练的PTQ受到了越来越广泛的关注,并出现了许多优秀的作品。OMSE建议通过最小化量化误差来确定激活的值范围。AdaRound提出了一种新的舍入机制来适应数据和任务损失。

除了上述针对神经网络的工作外,Liu等人还提出了一种具有相似性感知和秩感知策略的Vision Transformer训练后量化方法。然而,这项工作没有量化Softmax和LayerNorm模块,导致量化不完整。在本文的FQ-ViT中,目标是在PTQ范式下实现精确、完全量化的Vision Transformer。

相关更多细节,我们请点击原文查看相关原理。

6. ***开发为什么这么难?2023 中国芯片开发者调查报告发布

https://mp.weixin.qq.com/s/WY04ogsgLngZdoZQF6YyEA

造芯难,随着各产业的发展,研发不同场景下的芯片更难。

不久前,OPPO 芯片设计子公司哲库关停,两名高管在最后一次会议上几度哽咽,宣布因为全球经济和手机行业不乐观,公司的营收远远达不到预期,芯片的巨大投资让公司无法负担,最终 3000 多人原地解散。这一消息迅速席卷全网,也给半导体行业带来一抹悲凉的色彩。

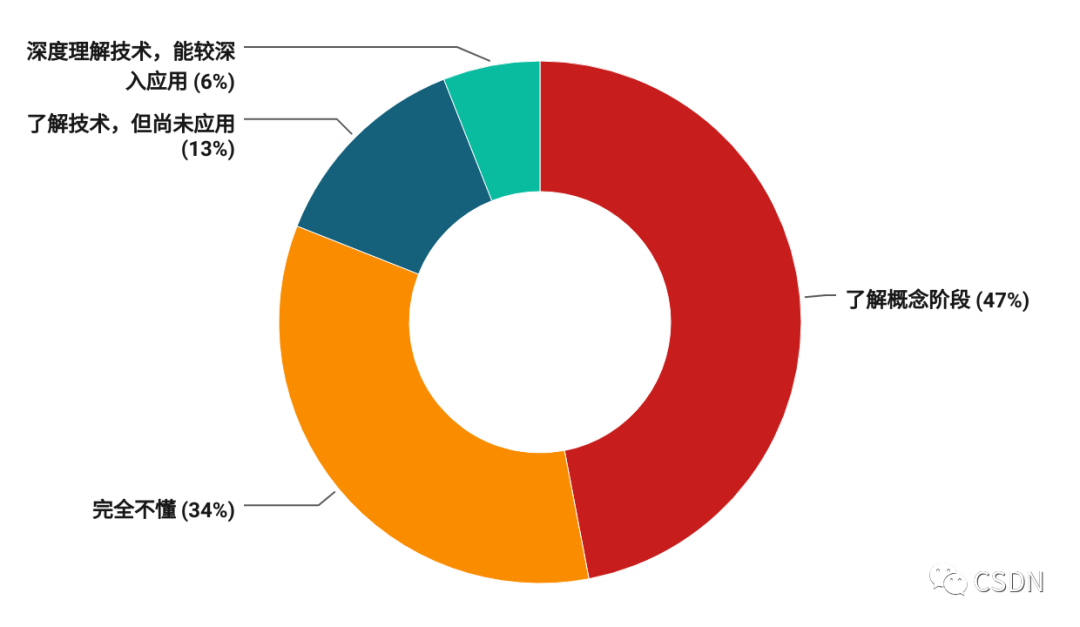

事实上,近几年来,随着国际竞争环境的演变,以及半导体行业的长周期性,芯片行业面临着多维度的挑战。日前,CSDN 从开发者、工程师维度进行了深度的调研,最新发布了《2023 中国芯片开发者调查报告》,分享开发者认知中的芯片行业现状,揭晓***研发的重点难题,希望借此能够为半导体行业的从业者、企业、学术研究带来一些思考。

芯片人才缺失严重,软硬协调能力培养需重视

一直以来,芯片从设计到制造从未有过坦途。这背后需要大量的知识积累和开发经验,但在国内这方面的人才储备仍然相对较少,这使得芯片研究和开发的进程受到了限制。

数据显示,开发者对芯片的了解程度存在较大差异。仅有 6% 的开发者能够深入理解技术,较深入应用。多数处于了解概念阶段,占比近五成。

究其背后,要开发芯片,相关从业者需要掌握一系列技术,包括但不限于:

-

逻辑设计:了解数字电路设计和逻辑门电路。你需要熟悉硬件描述语言(HDL)如 Verilog、VHDL,以及逻辑设计工具 EDA(Electronic Design Automation)等。

-

物理设计:涉及芯片的物理布局和布线。

-

模拟设计:熟悉模拟电路设计和模拟集成电路(IC)设计技术。这包括了解模拟电路元件、电路模拟工具如 SPICE(Simulation Program with Integrated Circuit Emphasis),以及模拟电路布局和布线。

-

时钟和时序设计:掌握时钟电路设计和时序分析,以确保芯片内各个模块的时序一致性和正确性。

-

半导体工艺技术:了解半导体制造工艺和工艺流程,包括光刻、薄膜沉积、离子注入、蚀刻等。这对于了解芯片制造过程和对芯片性能的影响非常重要。

-

芯片验证:了解芯片验证技术,包括功能验证、时序验证、功耗验证和物理验证。这包括使用仿真工具、验证语言(如 SystemVerilog)和硬件验证语言(如 UVM)。

-

芯片封装和测试:了解芯片封装和测试技术,包括封装类型选择、引脚布局、封装材料和测试方法。

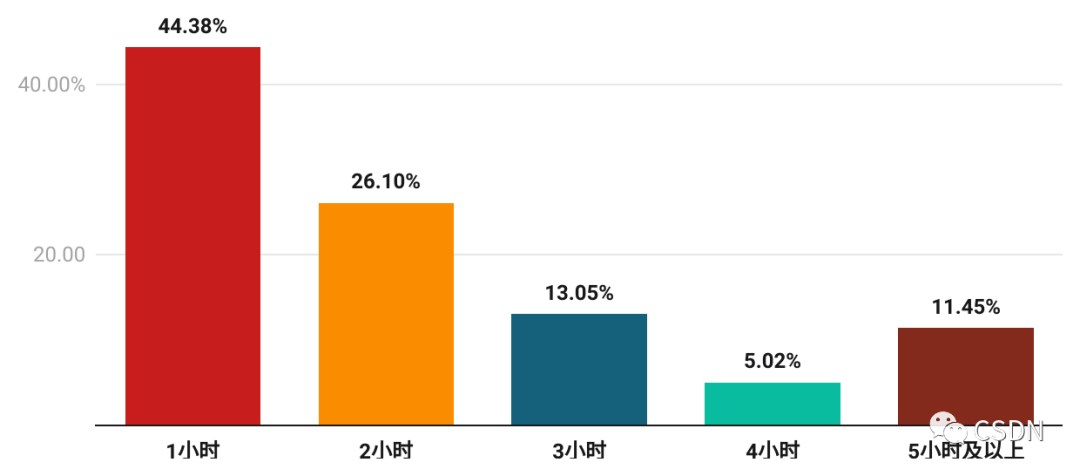

以上只是芯片开发中的一些关键技术,也属于冰山一角。因此,芯片开发人员需要不断学习来提高自身的技术水平和竞争力。数据显示,芯片相关从业者有超过半数的人,每天至少学习 1 小时以上。

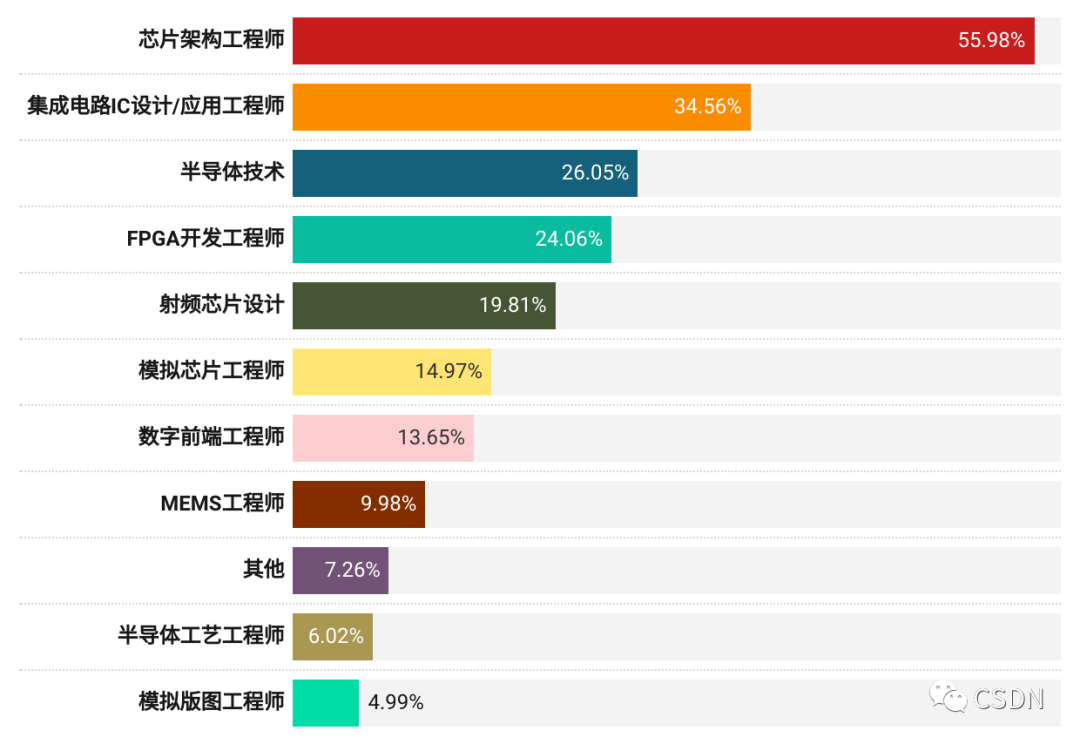

对于芯片开发这个复杂的任务,随着物联网、5G 网络、人工智能等领域的快速发展,对高性能芯片的需求越来越大,而这种需求又远远超过了现有的芯片工程师数量。55.98% 的开发者表示,他们团队当前最急需的是芯片架构工程师。其次是集成电路 IC 设计/应用工程师、半导体技术工程师。

对此,中国科学院计算技术研究所副所长包云岗点评道,芯片设计人才严重短缺,软硬件协同能力培养需重视。在调研的开发者中,只有 6% 的开发者能够深入理解芯片技术,也就是芯片设计人员仅占软件开发人员的 1/16 左右(6% vs. 94%)。用软件行业来对比,2021 年软件相关产品营业额约为 36000 亿(软件产品收入 26583 亿元+嵌入式系统软件收入 9376 亿元),芯片设计行业产值约为软件开发行业产值的 1/7。这些统计数据口径并不一致,但也一定程度上能反映出芯片设计人员的严重短缺。

小团队作战,AI 成为芯片应用的重要场景之一

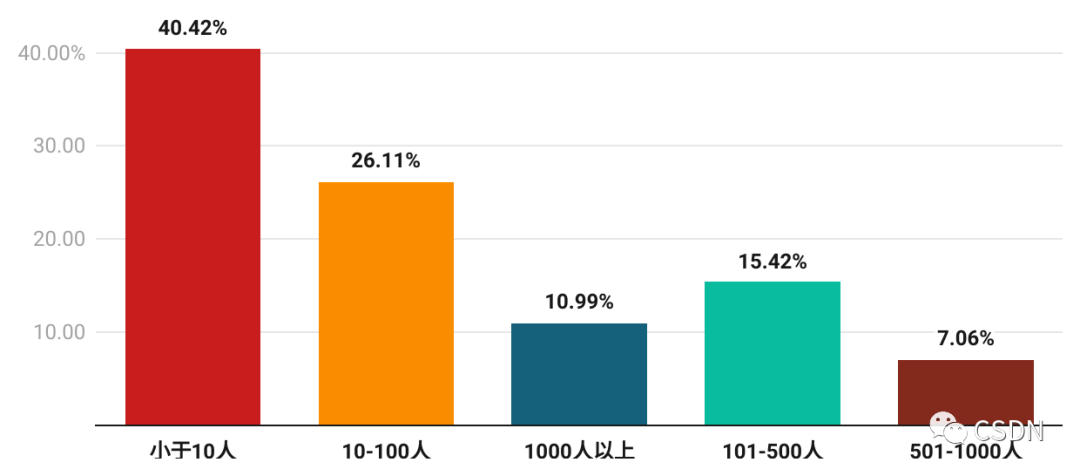

放眼当前国内芯片市场入局的公司规模,呈现出一定的分散趋势。40.42% 的公司人数小于 10 人,这些公司可能是由独立的芯片设计师或者小团队组成,可能主要专注于某个细分领域的应用开发。

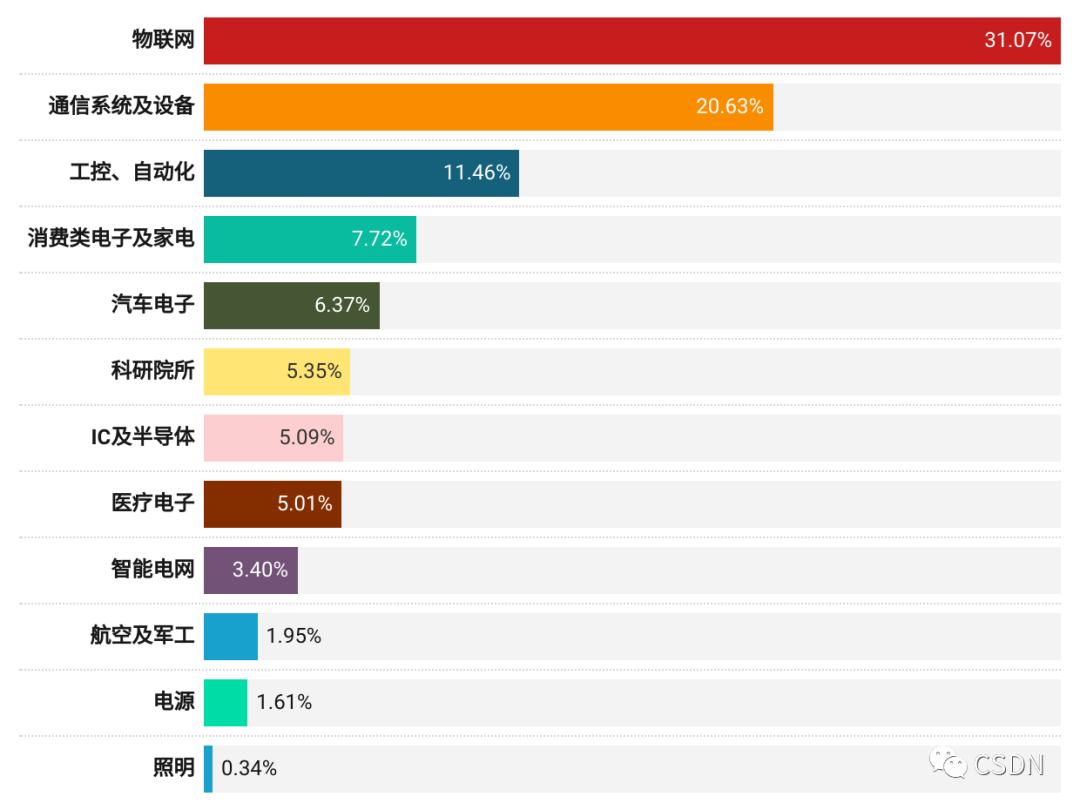

数据显示,当前的芯片公司的芯片主要服务于物联网以及通信系统及设备。其中,物联网占比最大且远高于其他产品/服务,占比 31.07%,其次为通信系统及设备,占比 20.63%。

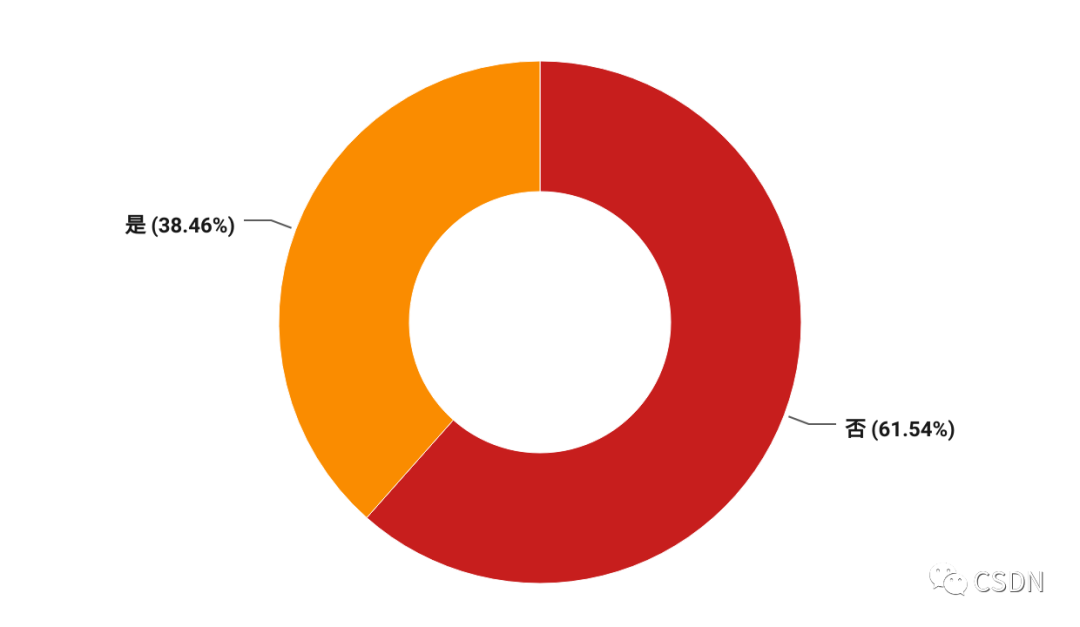

人工智能蓬勃发展,越来越多的专用芯片设计用于人工智能领域,它们的特点是针对特定的计算任务进行了高度优化。数据显示,在国内的芯片公司中,有 38.46% 的芯片是搭载人工智能技术的,能为人工智能应用提供更加高效的计算能力。

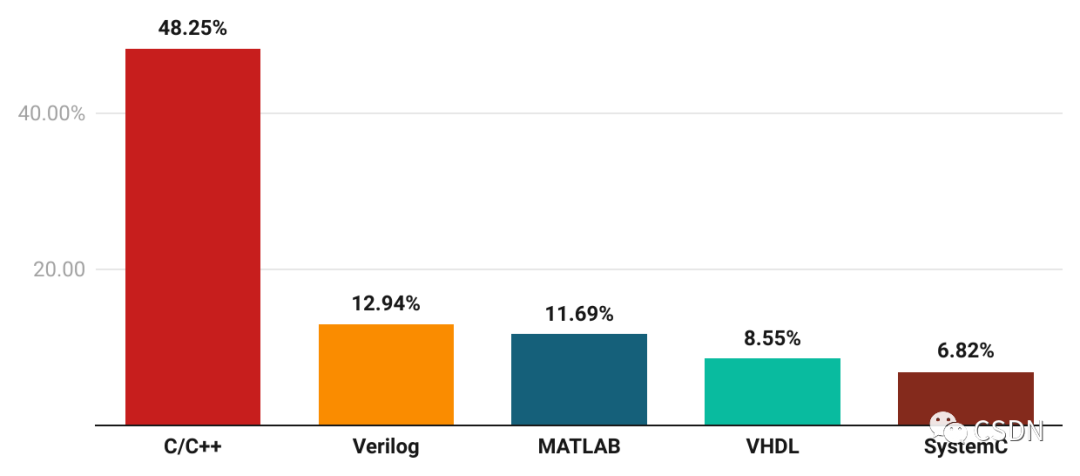

在芯片开发工具层面,芯片开发人员在开发语言的选择上多样性较高,其中最常用的两种语言分别是 C/C++ 和 Verilog。C/C++ 是一种常见的通用程序设计语言,可用于高级的应用程序和底层系统编程,数据显示,近五成的开发者在使用它们进行编写代码;而 Verilog 则是一种硬件描述语言,主要用于数字电路的建模和仿真,使用的开发者占比 12.94%。

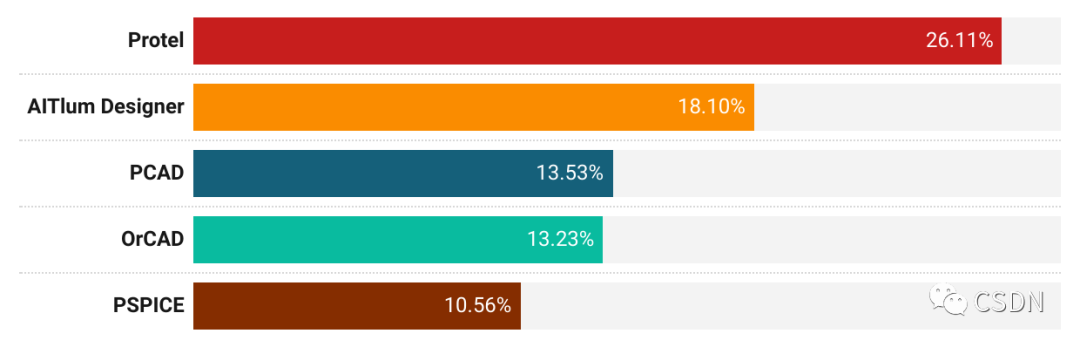

芯片开发中使用的 EDA 工具多种多样,且芯片开发人员常用的 EDA 工具呈现出多样性和分散性。

数据显示,使用最广泛的工具是 Protel,占 26.11%;其次是 AlTIum Designer,占 18.10%;开发人员可以根据自己的需求、意愿和实践经验,选择最适合自己的工具来进行芯片设计、仿真和测试。

***开发的挑战:设计、低功耗和专利

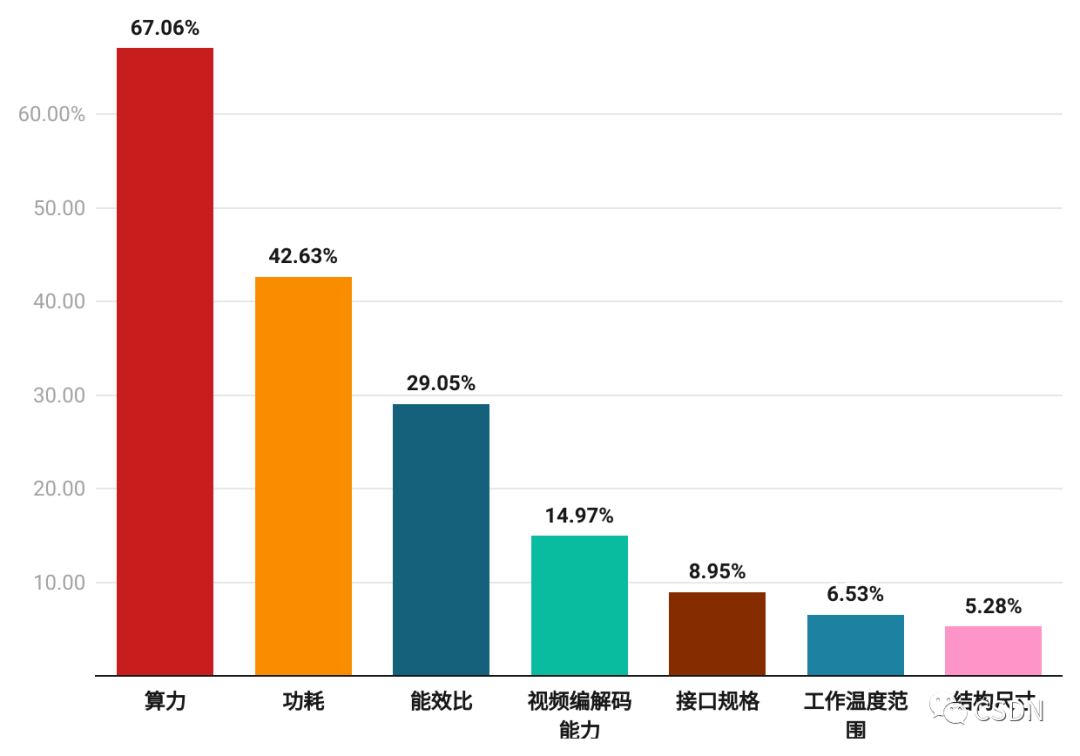

在现代技术中,芯片作为基础设施之一,芯片参数也是开发者们最为关注的话题。首先是算力,它衡量芯片处理速度的指标,67.06% 的开发者表示他们关心芯片算力参数;其次是功耗,它也是衡量芯片的重要指标之一,42.63% 的开发者也比较关心。

***在开发中面临很多挑战和难题,以下是一些主要的方面:

-

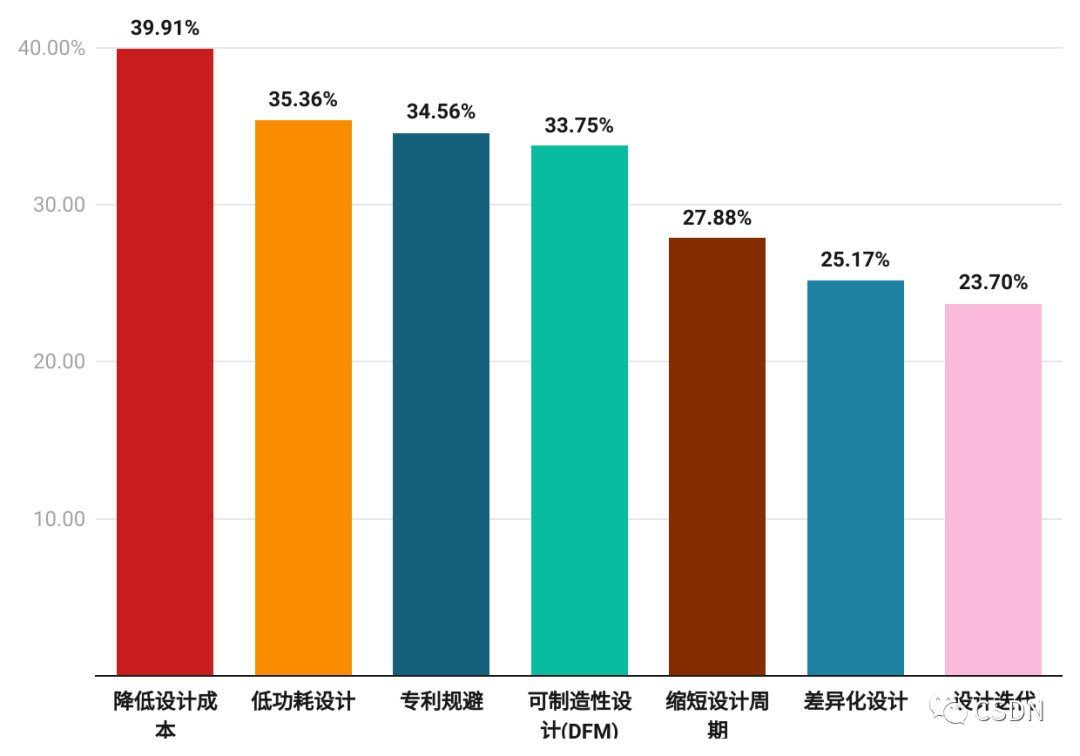

设计能力:芯片设计是复杂而艰巨的工作,需要高超的技术和精湛的设计能力。39.91% 的开发者表示,当前以国内的设计能力,很难去降低芯片设计成本。其次便是低功耗设计,35.36% 的开发者表示要实现低功耗也非常困难。

-

专利保护:芯片制造涉及到大量的专利技术,国内芯片开发中,需要进行专利规避

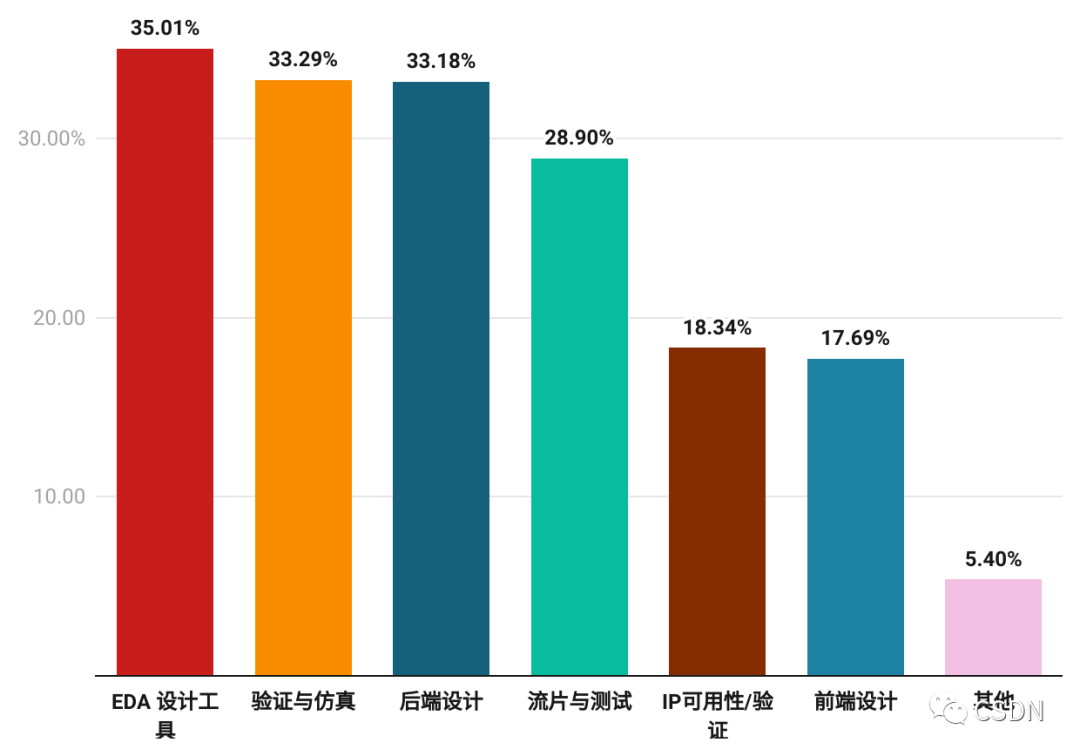

在芯片设计上,开发者最担忧的是 EDA 设计工具,现代芯片的复杂度非常高,一个芯片可能包含数十亿个晶体管和数百万条线路,因此设计过程中需要更优秀的工具来帮助工程师处理如此巨大的设计空间。

芯片制造与软件开发流程不同,不能像软件开发那进行小步快跑的迭代,整个制造过程的成本也比较高。

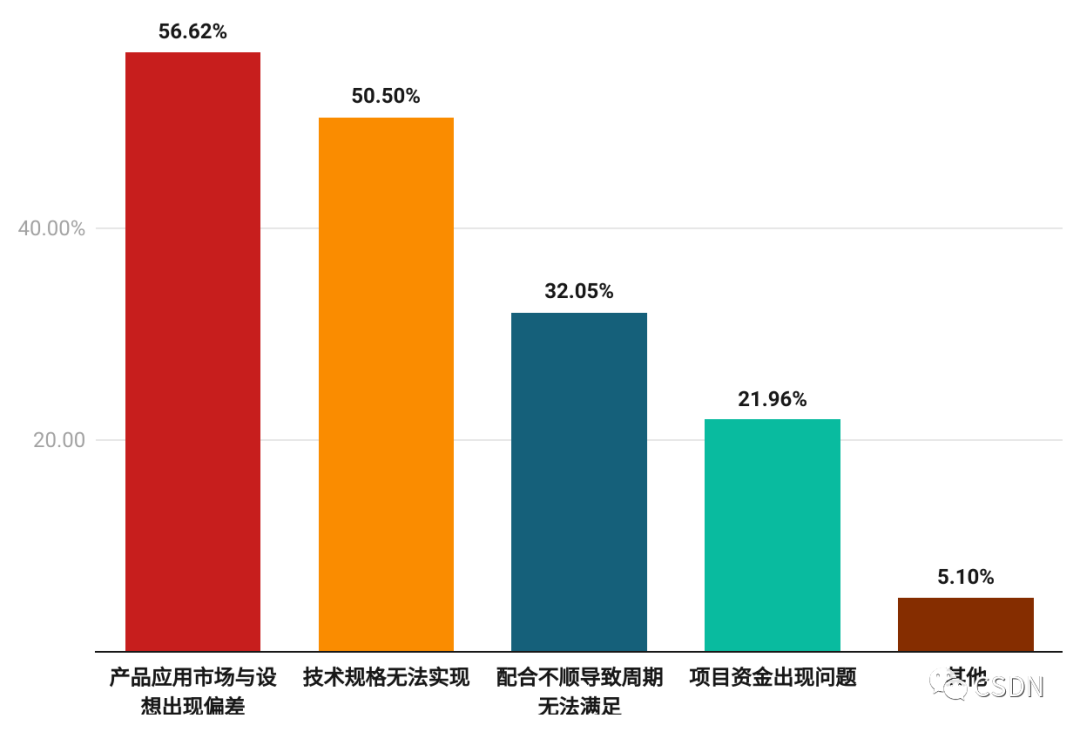

56.62% 的开发者认为在芯片制造中,容易出现产品应用市场与设想出现偏差,从而导致研发投入、生产成本等方面的浪费。其次是在芯片开发过程中,某些设计规格无法实现,半数的开发者都对此表示担心。

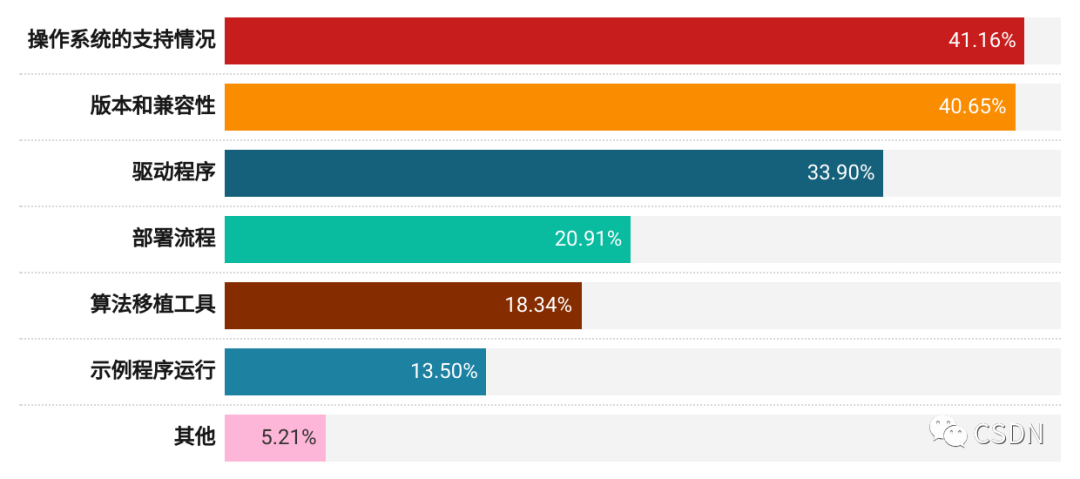

包云岗认为,超过 41% 的开发者最关心的是芯片对操作系统的支持情况。由此可见,优秀的芯片设计人才不仅仅懂芯片架构,也需要懂操作系统等软件栈知识。然而,这类人才在国内更是稀缺,因为很多集成电路学院并不开设操作系统等软件课程。要解决人才急缺问题,当前人才培养理念与方案需要改变,需要更重视软硬件协同能力的培养。开源芯片的未来

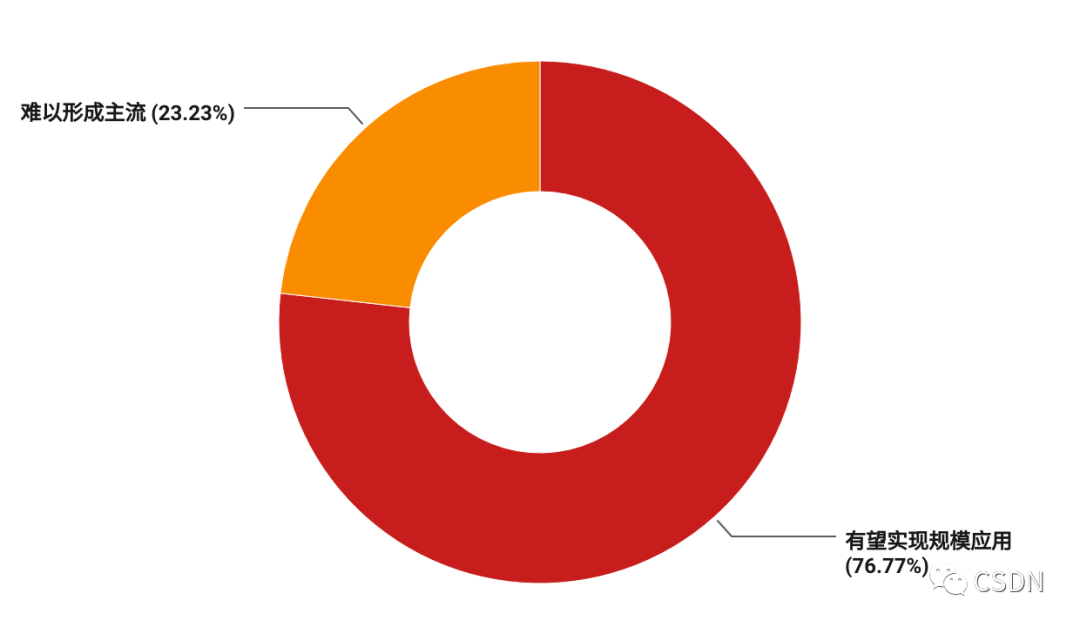

随着开源芯片技术的日益成熟,其市场份额也将逐渐增加,开源芯片平台如 RISC-V 等已经被广泛应用于各种应用场合。它作为一项新兴技术,其未来的发展前景非常广阔,76.77% 的开发者都看好开源芯片的发展,有望实现规模应用,将会在未来的几年中迎来爆发式增长。

包云岗认为,超过 41% 的开发者最关心的是芯片对操作系统的支持情况。由此可见,优秀的芯片设计人才不仅仅懂芯片架构,也需要懂操作系统等软件栈知识。然而,这类人才在国内更是稀缺,因为很多集成电路学院并不开设操作系统等软件课程。要解决人才急缺问题,当前人才培养理念与方案需要改变,需要更重视软硬件协同能力的培养。开源芯片的未来

随着开源芯片技术的日益成熟,其市场份额也将逐渐增加,开源芯片平台如 RISC-V 等已经被广泛应用于各种应用场合。它作为一项新兴技术,其未来的发展前景非常广阔,76.77% 的开发者都看好开源芯片的发展,有望实现规模应用,将会在未来的几年中迎来爆发式增长。 整体而言,包云岗总结道,新兴领域芯片需求快速增长,开源芯片未来可期。

一方面,报告中显示当前芯片主要服务于物联网(31%)以及通信系统及设备(21%)。在调研的企业中,研发的芯片中有 38% 搭载人工智能技术,这也反映了当前人工智能领域的蓬勃发展。两项数据结合,可以大致反映出很多物联网场景也有人工智能需求。

另一方面,在被调研的芯片公司中,40% 的公司人数小于 10 人,26%的公司人数为 10-100 人。结合 2022 年 12 月魏少军教授在 ICCAD 会上的关于中国芯片设计产业总体发展情况的报告数据显示,全国甚至有 2700 余家(占84%)芯片设计公司人数不足 100。

总之,国内绝大多数芯片设计企业人员规模并不大,他们主要专注于某个细分领域的芯片开发。这些企业的存在是因为物联网等新兴领域带来的芯片碎片化需求,而以 RISC-V 为代表的开源芯片允许企业更方便地定制芯片,是应对碎片化需求的有效方式,也有助于实现企业非常关心的降低芯片设计成本的需求。

整体而言,包云岗总结道,新兴领域芯片需求快速增长,开源芯片未来可期。

一方面,报告中显示当前芯片主要服务于物联网(31%)以及通信系统及设备(21%)。在调研的企业中,研发的芯片中有 38% 搭载人工智能技术,这也反映了当前人工智能领域的蓬勃发展。两项数据结合,可以大致反映出很多物联网场景也有人工智能需求。

另一方面,在被调研的芯片公司中,40% 的公司人数小于 10 人,26%的公司人数为 10-100 人。结合 2022 年 12 月魏少军教授在 ICCAD 会上的关于中国芯片设计产业总体发展情况的报告数据显示,全国甚至有 2700 余家(占84%)芯片设计公司人数不足 100。

总之,国内绝大多数芯片设计企业人员规模并不大,他们主要专注于某个细分领域的芯片开发。这些企业的存在是因为物联网等新兴领域带来的芯片碎片化需求,而以 RISC-V 为代表的开源芯片允许企业更方便地定制芯片,是应对碎片化需求的有效方式,也有助于实现企业非常关心的降低芯片设计成本的需求。

———————End———————

RT-Thread线下入门培训

6月 - 郑州、杭州、深圳

1.免费2.动手实验+理论3.主办方免费提供开发板4.自行携带电脑,及插线板用于笔记本电脑充电5.参与者需要有C语言、单片机(ARM Cortex-M核)基础,请提前安装好RT-Thread Studio 开发环境

立即扫码报名

报名链接

https://jinshuju.net/f/UYxS2k

巡回城市:青岛、北京、西安、成都、武汉、郑州、杭州、深圳、上海、南京

你可以添加微信:rtthread2020 为好友,注明:公司+姓名,拉进RT-Thread官方微信交流群!

点击阅读原文,进入RT-Thread 官网

原文标题:【AI简报20230602】能听懂语音的ChatGPT来了!***开发调查报告发布

文章出处:【微信公众号:RTThread物联网操作系统】欢迎添加关注!文章转载请注明出处。

-

RT-Thread

+关注

关注

31文章

1285浏览量

40082

原文标题:【AI简报20230602】能听懂语音的ChatGPT来了!国产芯片开发调查报告发布

文章出处:【微信号:RTThread,微信公众号:RTThread物联网操作系统】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

ChatGPT新增实时搜索与高级语音功能

大联大推出基于MediaTek Genio 130与ChatGPT的AI语音助理方案

讯飞开放平台携手开发者共建繁荣生态

韩企人工智能使用率仅为30.6%

OpenAI 深夜抛出王炸 “ChatGPT- 4o”, “她” 来了

苹果首款折叠屏MacBook或提前至2026年发布

富士通发布2024 SX调查报告 揭示可持续发展的关键成功因素

【AI简报20230602】能听懂语音的ChatGPT来了!***开发调查报告发布

【AI简报20230602】能听懂语音的ChatGPT来了!***开发调查报告发布

评论