车马先行,粮草呢?

据外泄的消息显示,OpenAI CEO山姆·阿尔特曼上个月在伦敦与软件开发者召开的闭门会议上表示,缺少专用计算机芯片打乱了公司的经营计划。

OpenAI的人工智能软件必须使用专用计算机芯片,而芯片荒阻碍了该公司的业务,并且除了ChatGPT以外,该公司并不打算发布面向消费者的产品。据报道,OpenAI联合创始人兼首席执行官山姆·阿尔特曼两周前在伦敦与软件开发者和初创公司CEO们召开了一次非公开会议。一位与会者的博客爆料称,阿尔特曼在会上披露了许多信息,以上的信息只是其中的两条。据称此次会议约有20人参会。最初发表这篇博客的页面显示,应OpenAI的要求,爆料此次闭门会议的账号已经关闭,但这并没有阻止人工智能界深入分析这位有影响力的CEO的(所谓的)言论。

一个互联网存档网站已经保存了一份原博客的副本,之后文章内容在社交媒体和程序员聚集的多个论坛上广泛传播。人工智能专家拉扎·哈毕比在博客中写道,阿尔特曼表示,OpenAI无法买到足够多运行人工智能应用需要使用的专用计算机芯片图形处理单元(GPU),这阻碍了公司的短期计划,也为使用OpenAI服务的开发者带来了麻烦。哈毕比是Humanloop公司的联合创始人兼CEO。哈毕比的初创公司位于伦敦,该公司率先提出了提高大语言模型训练效率的方法。大语言模型是OpenAI ChatGPT使用的基础技术。

GPU荒导致OpenAI更难支持用户通过大语言模型推送更多数据,并延缓了公司发布更多功能和服务的计划。该公司的ChatGPT等产品均以大语言模型作为核心。此外,博客中表示,芯片荒还降低了OpenAI现有服务的速度和可靠性,这会令客户不满,使他们不愿意基于OpenAI的技术开发企业应用。OpenAI在生成式人工智能繁荣中的先行者优势,也会因为芯片供应紧张而面临威胁,因为谷歌(Google)和其他知名度较低的竞争对手都有能力推出竞争性服务,而且开源竞争对手已经进一步站稳脚跟。

关于“语境窗口”

阿尔特曼列举了OpenAI因为硬件(如芯片)短缺无法开展的多项业务。哈毕比在博客中写道,其中包括向其GPT大语言模型的大多数客户提供更长的“语境窗口”。语境窗口决定了在模型中输入一条提示词可以调用的数据数量,以及模型的响应时间。大多数GPT-4用户的语境窗口支持的标记数量为8,000个(一个标记是人工智能模型进行预测所依据的一段数据,相当于约一个半英文单词)。OpenAI在3月宣布为其模型的精选客户提供支持32,000个标记的语境窗口,但很少有用户能够使用该功能,哈毕比的博客称,阿尔特曼将此归咎于GPU短缺。

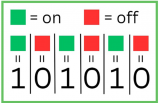

全球大多数人工智能应用在GPU上训练和运行。GPU作为一种计算机芯片,通过高速并行处理进行数据分析。大多数GPU芯片来自一家公司,那就是英伟达(Nvidia),而且售价可能高达数千甚至数十万美元。市场观察家已经发现,由于英伟达与生成式人工智能繁荣的关联,其股价暴涨,而且其市值最近突破了1万亿美元。

哈毕比在博客中爆料,OpenAI联合创始人兼CEO还向开发者保证,除了ChatGPT以外,OpenAI没有计划发布任何面向消费者的产品。哈毕比称,许多参会的开发者告诉阿尔特曼,他们对于使用OpenAI的人工智能模型进行开发感到担心,因为无法确定OpenAI是否会发布竞争性产品。阿尔特曼表示,ChatGPT将是其唯一一款面向消费者的产品,而且公司的未来愿景是成为一款“超级智能的工作助手”,但OpenAI“不会涉足”许多需要使用GPT大语言模型的行业特定应用。

阿尔特曼还表示,他一个月前所说的“超大规模模型的时代”将要结束的观点被错误解读。他对开发者表示,他想要表达的意思是,OpenAI最强大的大语言模型GPT-4的规模已经足够庞大,因此公司不可能继续快速扩大人工智能系统的规模。他在伦敦会议上表示,OpenAI会继续创建更大的模型,但它们的规模只会有GPT-4的两倍或三倍,而不是扩大数百万倍。

爆料称,阿尔特曼在与开发者的对话中,还分享了OpenAI的近期发展规划。哈毕比的博客称,阿尔特曼表示,在2023年,OpenAI的目标是提高GPT-4的运行速度和降低其成本,提供更长的“语境窗口”以支持用户向OpenAI的GPT模型中输入更多数据并获得更长的输出结果,推出更方便客户根据具体使用案例调整GPT-4的方法,并支持ChatGPT及其大语言模型能够保留历史对话记忆,从而使用户想要继续未完成的对话或重复与模型的互动时,不需要每次都要重复按照相同的顺序输入提示。

阿尔特曼表示,公司明年的工作重点是发布GPT-4根据输入的图片输出结果的能力。OpenAI在3月发布该模型时演示了这项功能,但尚未向大多数客户开放。

哈毕比写道,在监管方面,阿尔特曼对开发者表示,他并不认为现有模型带来了任何严重的风险,而且“对现有模型进行监管或者禁用将是严重的错误”。阿尔特曼重申了他公开的立场,即OpenAI认同开源人工智能软件的重要性,并证实了科技刊物《The Information》关于OpenAI正在将其某一款模型开源的报道。博客称,阿尔特曼表示,公司可能将其GPT-3模型开源,但到目前为止之所以没有这样做,是因为阿尔特曼“怀疑有多少个人和公司有能力托管和服务”大语言模型。

据称阿尔特曼在闭门会议上表示,OpenAI仍在分析OpenAI Plus的用户希望如何使用这款插件。该插件支持大语言模型使用其他软件。哈毕比在博客中表示,这可能意味着这款插件尚未达到产品与市场契合的程度,因此在短期内不会通过OpenAI的API向企业客户发布。

哈毕比和OpenAI并未立即回复置评请求。

哈毕比的博客在社交媒体和开发者论坛上引起了激烈讨论。许多人表示,阿尔特曼的言论证明了GPU荒问题对于释放大语言模型的商业潜力的重要性。也有人表示,这证明了来自开源人工智能社区的许多创新对于人工智能未来的重要性。开源社区开发的创新途径,可以使用更少算力和更少数据,实现与规模最大的专有人工智能模型类似的性能。

Signal基金会(Signal Foundation)的总裁、大型科技公司的主要批评者梅雷迪思·惠特克在柏林召开的一次会议上接受场边采访时表示,这篇博客表明,全球最大的科技公司扼制了当前人工智能软件的基础,因为只有这些大公司有实力提供训练最大规模的人工智能模型所需要的计算资源和数据。她说到:“看得出来,尽管OpenAI能够使用微软(Microsoft)的基础设施,但对其约束最大的因素是GPU。”她提到的是OpenAI与微软的合作。到目前为止,微软在来自旧金山的人工智能初创公司OpenAI投资了130亿美元。 “你必须有超级昂贵的基础设施才能这样做。”她表示,人们不要误以为开源人工智能社区存在,就代表“行业格局是真正民主化和竞争性的”。

-

GPU芯片

+关注

关注

1文章

303浏览量

5804 -

计算机芯片

+关注

关注

0文章

42浏览量

3506 -

OpenAI

+关注

关注

9文章

1079浏览量

6480 -

ChatGPT

+关注

关注

29文章

1558浏览量

7592

原文标题:OpenAI恐遭遇芯片荒

文章出处:【微信号:ICViews,微信公众号:半导体产业纵横】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

OpenAI恐遭遇专用计算机芯片荒

OpenAI恐遭遇专用计算机芯片荒

评论