去年年底,ChatGPT诞生,凭借强大、精准的自然语言理解和生成能力,令全球用户为之一震。

自此,各行各业纷纷投身大模型研发竞赛,掀起新一轮技术创新热潮。金融行业更是如此。如何构筑面向大模型时代的新型算力和存力基础设施,实现大模型能力向金融领域的迁移,成为金融机构热议的话题。

金融大模型 在哪些场景有用武之地?

作为AI新基建,大模型在金融行业有着广泛的应用场景。

在前台,智能客服,是AI在金融领域最常见的应用方向之一。还记得钢铁侠电影里的AI管家贾维斯(Jarvis)么?金融大模型将大幅提升客户经理的专业水平和服务能力,大幅降低客户经理的运营成本,让每个人都拥有类似Jarvis的24小时在线的专业客户经理。

在中台,AI大模型有机会改变金融机构内知识获取、内容创作、会议与沟通、代码开发与测试的方式,提升内部办公效率,甚至引发研发测试模式变革,全方位提升金融机构内部运营效率。

在后台,大模型将成为智能科技底座的标配,大幅降低智能技术应用的门槛,只需少量标注数据就可以让智能技术覆盖广泛的场景。

总之,AI大模型在内容生成与创作、信息摘要与总结、知识理解与问答、自然交互与对话等方面具备非常出色的能力,在金融行业有广泛的应用前景。

万卡规模、万亿参数,大模型有“高门槛”

大模型的快速迭代,需要高效算力和存储基础设施的加持。

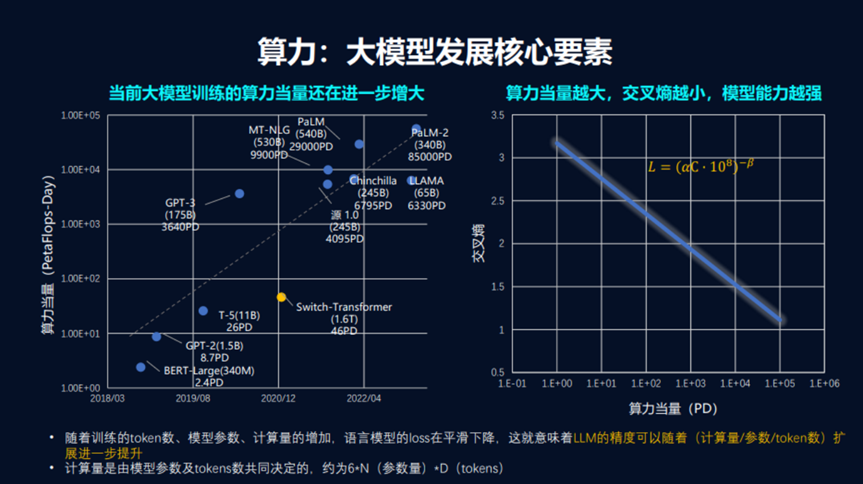

一方面,算力是大模型的引擎。语言类、视觉类模型容量和相应的算力需求都在快速扩大,金融大模型发展的背后是庞大的算力支撑。如果用“算力当量”(PetaFlops/s-day,PD),即每秒千万亿次的计算机完整运行一天消耗的算力总量,来对人工智能任务所需算力总量进行度量,大模型训练需要几百甚至几千PD的算力支持,也意味着需要巨大的算力成本。

算力是大模型发展核心要素

例如,OpenAI 在2020 年推出的 GPT-3,对算力的需求至少要上万颗A100 GPU,一次模型训练总算力消耗约3,640PD的算力。又如,浪潮信息推出的“源”中文语言大模型有近2500亿个模型参数,算力消耗达4000PD。再如,当前GPT-4和PaLM-2的算力当量已经达到GPT-3的数十倍。这还不算,谷歌正在开发的下一代多模态大模型Gemini,其训练量碾压GPT-4,达到后者5倍。

快速攀升的AI算力消耗,有限的IT预算,让大多数金融机构陷入两难境地:想做大模型,但资源匮乏、成本压力大、人才稀缺;不做大模型,又只能坐看机会错失。

对此,分而治之或许是一种可行的办法。所谓分,就是把大模型分为通用大模型和行业大模型。金融机构不用自己打造通用大模型,而是基于第三方的通用大模型,在此基础上专注打造行业大模型。根据信通院发布的《行业大模型标准体系及能力架构研究报告》,通用大模型缺乏专业知识和行业数据,而且构建和训练成本很高,难以实现商用。为更好解决特定行业为题,行业大模型应运而生。行业大模型可以满足特定场景需求,更好地为行业提供优质的服务,促进行业智能化转型升级。

浪潮信息AI服务器产品专家郭磊表示,“金融机构可以集中资源在行业大模型上,不是‘在一千米的地上挖一米深的沟’,而是‘在一米的地方挖一千米深’”。

大模型训练四个阶段

具体来看,大模型训练的第一阶段是无监督预训练阶段,训练周期往往持续数十天到数月,需要数千张GPU卡同时计算,算力消耗巨大,训练时间非常长,训练出来的模型是基础语言模型。金融机构可以通过使用开源平台或者第三方合作(如浪潮信息的“源”大模型),获得基础语言能力。第二到第四阶段是有监督精调阶段、奖励模型训练和强化学习,这3个阶段需要数十张乃至上百张GPU卡同时计算,算力消耗的规模和训练时长相比第一阶段都有明显下降,所以金融机构可以在这三个阶段进行训练,打造有金融行业优势的大模型。

另一方面,大模型光有算力远远不够,还取决于数据规模和数据质量。

大模型的优势在于海量信息的搜集、提取和分析能力,这是人类难以企及的。

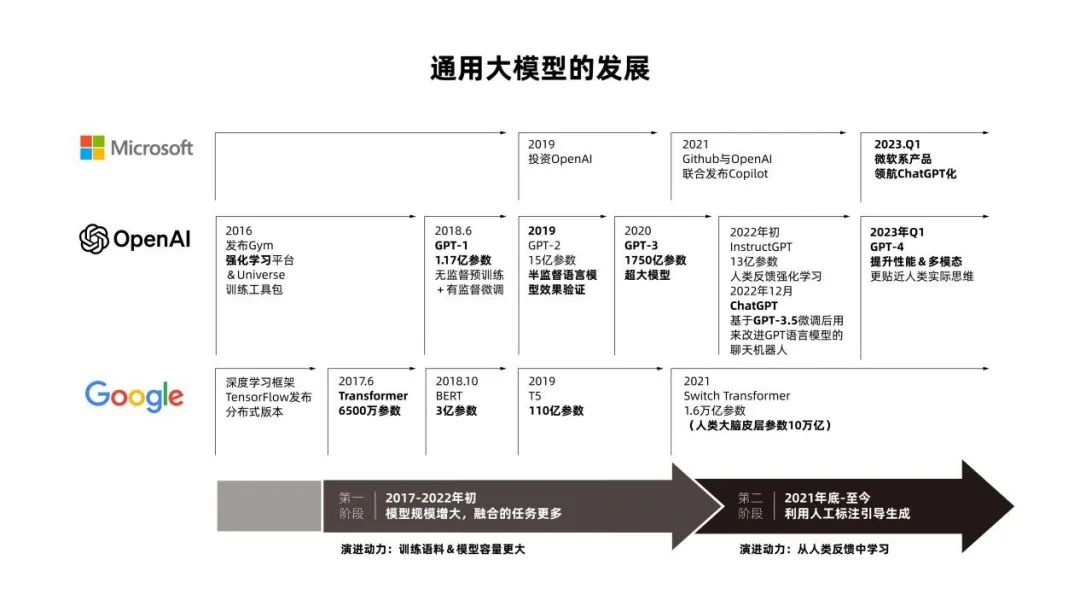

大模型参数规模的进化

近几年,通用大模型的参数量快速增长。2016年OpenAI发布Gym强化学习平台,2018年GPT-1问世,模型参数为1.17亿,经过不断迭代,GPT-4参数规模达到1.76万亿。Google从2017年发布Transformer(6500万参数)架构以来,陆续发布BERT(2018年,3亿参数)、T5(2019年,110亿参数),参数规模逐步提高。近期,Google发布通才模型PaLM-E,这是全球最大的视觉语言模型,包含5620亿参数。

在垂直行业,金融大模型的数据集在通用大模型基础上还需包含诸如金融研报、股票、基金、银行、保险等方向的专业知识,通过在训练过程中加入大量金融对话数据并针对金融领域进行特定的预训练调优,提升其在金融垂直领域的表现。

同时,多模态、跨模态成为常态,金融大模型的数据类型变得更加丰富。其中无监督数据,即原始数据,数据格式可以是网页、文本或语音数据;有监督数据,即经过标注的数据,格式可以为json或Query。此外,为了给投资者提供实时市场舆情和风险预测等服务,金融机构还要高效处理金融行业新闻、股票交易,乃至社交评论等金融数据。这些巨量、多模态、实时的金融数据新需求、新特征,传统集中式存储难以应对,需要弹性、灵活的新型分布式存储架构来支撑。

由此可见,随着金融大模型的演进,整个数据中心的架构都会发生改变,从AI服务器、到存储、再到网络的全栈方案都需要适应大模型时代的需求。

基础设施 如何“存得下、算得快、传得稳”

只有数据“存得下”、算力“算得快”、网络“传得稳”,数字基础设施才能充分发挥数据要素价值,推动大模型应用落地,带动新业态繁荣发展。

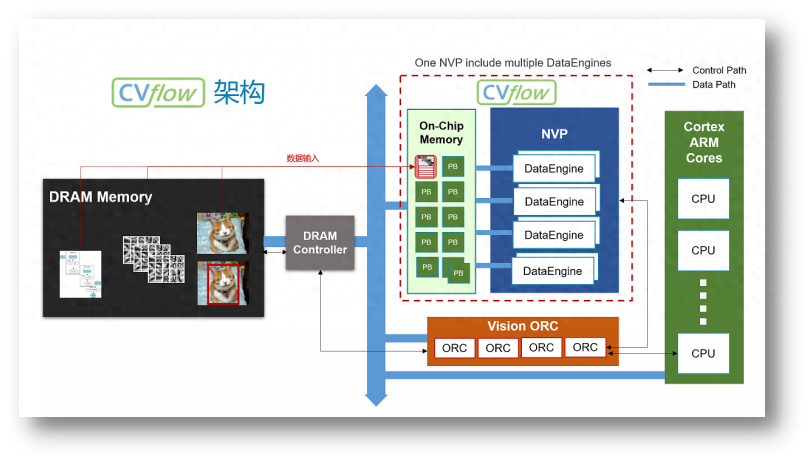

对此,浪潮信息基于智慧计算战略,从算力、算法、数据、互联四方面推进产品创新,为大模型打造强大底座。

算力方面,浪潮信息通过千亿参数规模的大模型创新实践,已在算力集群构建、算力调度部署、算法模型开发等方面,构建起全栈领先的大模型算力系统解决方案,助力大模型训练开发。其中最新一代融合架构的 AI 训练服务器 NF5688G7 采用 Hopper 架构的 GPU, 较上代平台大模型实测性能提升近 7 倍,同时支持最新的液冷解决方案,可实现更低的集群能耗比与运行成本,PUE 小于 1.15, 以一个 4000 卡的智算中心为例,每年可节电 620 万度、降碳 1700 吨。

存储方面,浪潮信息生成式AI存储解决方案用一套AS13000融合存储支撑生成式AI的全阶段应用,提供全闪、混闪、带库、光盘四种介质,支持文件、对象、大数据、视频、块多种协议。结合AIGC数据处理的五个阶段:数据采集、准备、训练、推理和归档,浪潮信息由同一套存储提供端到端的数据流支持,满足文本、音频、图像、视频、代码等多模态数据的存储和处理需求。

浪潮信息存储产品

在集群高速互联层面,浪潮信息基于原生 RDMA 实现整个集群的全线速组网,并对网络拓扑进行优化,可以有效消除混合计算的计算瓶颈,确保集群在大模型训练时始终处于最佳状态。

当前,国有大行、股份制银行以及部分城商行,均已经开展或计划开展金融大模型研发,AI算力和数据基建将迎来高速发展。根据IDC预测,未来5年中国智能算力规模的年复合增长率将达52%,分布式存储增速将达到中国市场增速的2倍。大模型时代,金融机构需要以AI的场景、架构为抓手,结合各行的数据特点,打造新一代智算基础设施。

-

存储

+关注

关注

13文章

4296浏览量

85796 -

浪潮

+关注

关注

1文章

458浏览量

23850

原文标题:金融行业迎来大模型时代,存算基建成决胜关键

文章出处:【微信号:inspurstorage,微信公众号:浪潮存储】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

存力与算力并重:数据时代的双刃剑

【「大模型时代的基础架构」阅读体验】+ 未知领域的感受

名单公布!【书籍评测活动NO.41】大模型时代的基础架构:大模型算力中心建设指南

后摩智能推出边端大模型AI芯片M30,展现出存算一体架构优势

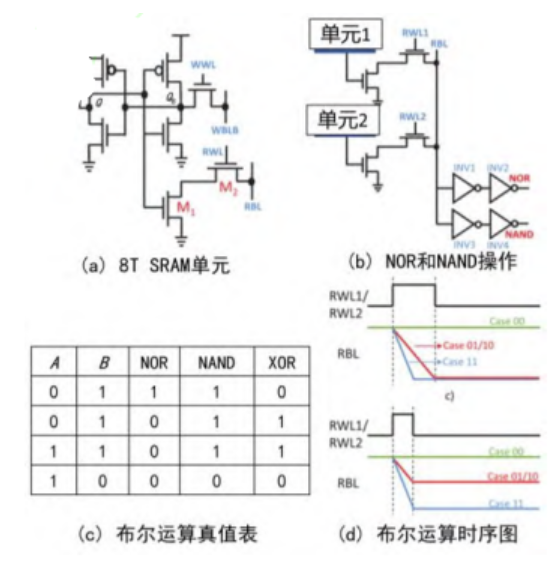

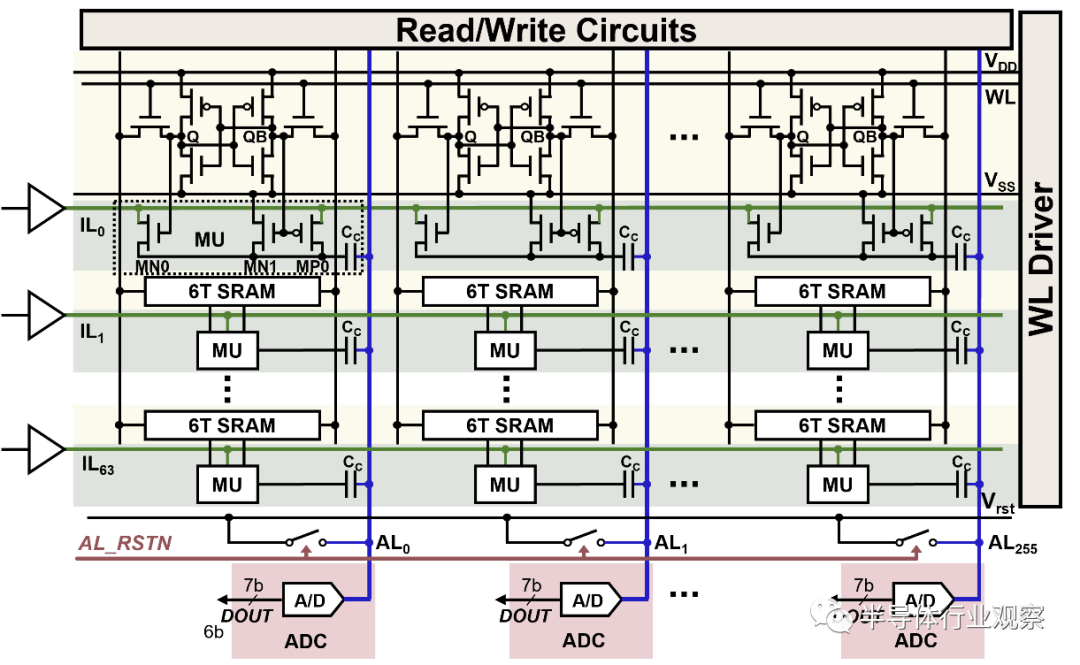

探索存内计算—基于 SRAM 的存内计算与基于 MRAM 的存算一体的探究

知存科技携手北大共建存算一体化技术实验室,推动AI创新

北京大学-知存科技存算一体联合实验室揭牌,开启知存科技产学研融合战略新升级

中国移动已建成运营商最大单体智算中心

商汤科技与海通证券携手发布金融行业首个多模态全栈式大模型

大算力时代, 如何打破内存墙

金融行业迎来大模型时代,存算基建成决胜关键

金融行业迎来大模型时代,存算基建成决胜关键

评论