什么是Stream

生产线

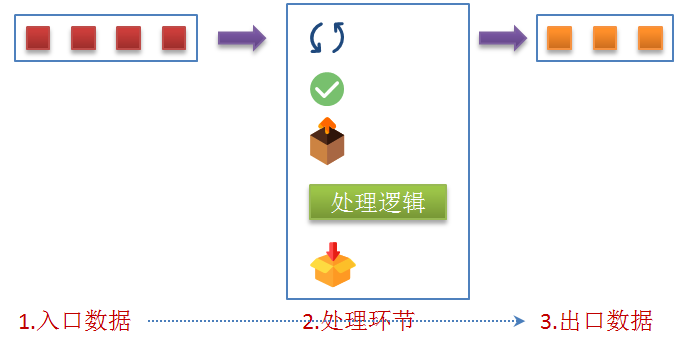

Stream就像处理生产流水线一样去工作,传送带就是Stream的管道,每个工厂关注直接的生产,将上游产品加工成下游需要的产品。为什么Stream比传统的处理方式好呢?我们都知道,传统的处理中,每一步我们都需要通过循环控制,逻辑控制,解包,重新装箱这些工作。

非生产线示意处理图

这些步骤让我们的程序的业务逻辑支离破碎,经常处理数据类的小伙伴尤为痛苦。幸运的是,Java8为我们引入了Stream,使用Stream后我们只关注数据处理逻辑,其他的事情交给流处理对应的方法来完成。

创建数据流

指北君先为大家介绍如何创建Stream,这里有非常多的方式,需要注意一点就是:流一旦创建后,修改创建的源不会影响已经创建的Stream中的数据。

- 空流 为了避免出现空指针异常,系统提供一个静态方法提供空流。

public void createStream() {

Stream< String > myStream = Stream.empty();

}

- 通过数组对象创建流

public void createStream() {

Integer[] arr = new Integer[]{1,2,3};

Stream< Integer > stream1 = Arrays.stream(arr);

Stream< Integer > stream2 = Arrays.stream(arr, 0, 2);

}

- 通过集合对象创建流

public void createStream() {

Collection< String > collection = Arrays.asList("a", "b", "c");

Stream< String > stream1 = collection.stream();

}

支持多种集合:List,Set,Map等实现了Collection接口的集合对象。

- 通过builder创建

public void createStream() {

Stream< Long > stream1 =

Stream.< Long >builder().add(1L).add(2L).add(3L).build();

}

- 通过generate生成

public void createStream() {

Random r = new Random();

Stream< Long > stream =

Stream.generate(() - > r.nextLong()).limit(10);

}

按照提供给generate的Supplier逻辑生成数据,通过limit限制生成的数据量

- 通过Stream.iterate创建

public void createStream() {

Stream< Integer > stream = Stream.iterate(1, n - > n * n).limit(20);

}

iterate提供两种方法来满足我们比较常用的迭代生成逻辑

- iterate(final T seed, final UnaryOperatorf)

- iterate(T seed, Predicate hasNext, UnaryOperatornext)

- 原生类型生成 通过对应的IntStream,LongStream,DoubleStream类中提供的方法来获取,包含常用的方法

- builder()

- empty()

- of()

- iterate()

- generate()

- range()

- concat()

- 其他地方 这里介绍两处:字符分割匹配和文件行数据

String.chars()返回IntStream

Files.lines()返回通过行分割的字符内容

流的使用机制(重要事项)

我们通过上面的方法创建好流后,就可以对流进行相关的业务逻辑处理了,需要注意:如果我们重复对一个流进行操作,就会出错,系统会爆出IllegalStateException异常,这是因为Stream设计为不可重用的模式。流的下一个环节都是对当前环节处理后新生成流的处理。

流的执行顺序

采用Stream方式进行多个逻辑处理时,他们之间的执行顺序是什么样的呢?指北君为了展示效果,写了一段测试代码:

public void exeOrder() {

List< String > list = Arrays.asList("data_1","data_2", "data_3", "data_12");

list.stream().filter(x - > {

System.out.println("filter() was called: " + x);

return x.contains("2");

}).map(x - > {

System.out.println("map() was called: " + x);

return x.toUpperCase();

}).forEach(x- >System.out.println("forEach() was called: " + x));

}

执行结果如下:

filter() was called: data_1

filter() was called: data_2

map() was called: data_2

forEach() was called: data_2

filter() was called: data_3

filter() was called: data_12

map() was called: data_12

forEach() was called: data_12

从示例代码的打印的顺序中我们可以发现:流处理的顺序不是以代码顺序(执行完一步再到下一步),而是按照数据处理完一个单位数据的所有环节再处理下一个数据,见下面的动态示意图:

Stream处理顺序

既然我们了解流的处理顺序,也能理解某些流操作会提前结束流处理的,比如findFirst(),在处理完第一个符合条件的数据后,后续的数据不会参与任何一个环节的处理。

转换处理

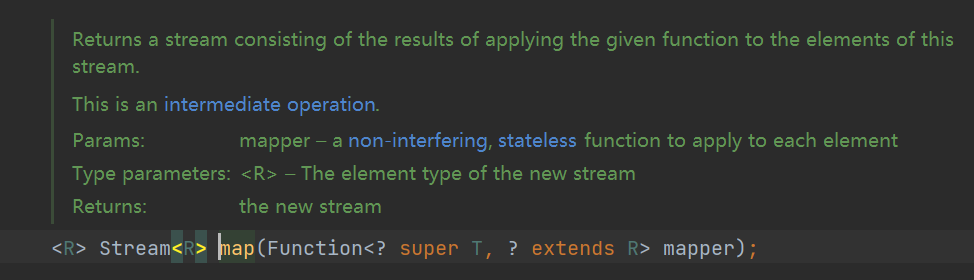

转换处理时最常用的逻辑处理方式,介绍转换处理的文章较多,这里不再一一详细描述只是简单列一下,转换处理对应大数据MapReduce中的Map处理

- distinct剔重

- filter过滤

- map转换映射

- peek

- limit

- skip

合并处理(reduce)

对于Map-Reduce模型的reduce操作,国内对这个词翻译不太统一,指北君就先称之为合并处理吧。这里介绍两个方法reduce和collect

- reduce 先来看一个reduce的示例

public void reduce() {

int sum = IntStream.range(1, 100).reduce(0, (a, b) - > a + b);

System.out.print(sum);

}

合并Stream中的所有值,合并的初始值为0,如果初始为0还可以省略初始值。reduce函数包含三部分关键信息:

- 初始值,指定合并操作的初始值

- 合并函数

- 合路器(函数),在并行(多线程)运算时需要用到

下面是一个使用合路器的示例,在并行运算时使用。

public void parallelReduce() {

int sum = Arrays.asList(1, 2, 3, 4, 5, 6, 7, 8, 9, 10).parallelStream()

.reduce(0, (a, b) - > a + b, (a, b) - > {

return a + b;

});

System.out.println(sum);

}

这里指北君留一道思考题给大家,如果这里初始值0修改为10,最终的结果是多少?为什么是这种结果呢?

- collect 现在我们再来看collect,collect严格上说是reduce有些牵强,因为是否reduce在于collect中的执行逻辑 比如这段:

List< String > collector = list.stream().map(Product::getName).collect(Collectors.toList());

然后再看下面的例子:

String mergString = list.stream().map(Product::getName).collect(Collectors.joining(", ", "[", "]"));

还有其他对应的方法:

- Collectors.averagingInt

- Collectors.summingInt

- Collectors.groupingBy

- Collectors.partitioningBy

各位小伙伴可以查看Collectors对应的API,这里就不一一列举了,总之,collect通过Collectors对象的API类完成合并处理。

-

接口

+关注

关注

33文章

8575浏览量

151014 -

JAVA

+关注

关注

19文章

2966浏览量

104700 -

字符

+关注

关注

0文章

233浏览量

25198 -

数据处理

+关注

关注

0文章

595浏览量

28554 -

Stream

+关注

关注

0文章

20浏览量

7968

发布评论请先 登录

相关推荐

Stream模块的基础用法和进阶用法

Stream API原理介绍

JAVA学习直通车(教程+书籍+100个实例+问题与解答)

JAVA常用系统类的使用 实验

如何利用Stream API来优化Java代码

JDK8 Stream数据流效率分析

java的stream编程调试技巧

怎么使用Java8的Stream API比较两个List的差异呢?

Java8的Stream流 map() 方法

Java的Stream的常用知识

Java的Stream的常用知识

评论