RNN(Recurrent Neural Network,循环神经网络)是一种专门用于处理序列数据的神经网络结构,它能够在序列的演进方向上进行递归,并通过所有节点(循环单元)的链式连接来捕捉序列中的时序信息和语义信息。RNN的提出基于记忆模型的想法,期望网络能够记住前面出现的特征,并依据这些特征推断后续的结果。由于其独特的循环结构,RNN在自然语言处理(NLP)、语音识别、时间序列预测等领域得到了广泛应用。

一、RNN的基本原理

1. 循环结构

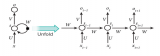

RNN的核心在于其循环结构,这一结构允许信息在不同时间步之间传递。在每个时间步,RNN接收当前的输入数据(如一个词的嵌入表示)和前一个时间步的隐藏状态,然后生成一个新的隐藏状态。这个新的隐藏状态不仅包含了当前时间步的信息,还融合了之前所有时间步的信息,因此RNN能够捕捉到序列数据中的上下文信息。

2. 隐藏状态

隐藏状态是RNN的记忆部分,它在每个时间步都会被更新。隐藏状态的计算通常包括将当前时间步的输入数据和前一个时间步的隐藏状态传递给一个激活函数(如tanh或ReLU),从而生成新的隐藏状态。这个隐藏状态随后会被用作下一个时间步的输入之一,同时也可能用于生成当前时间步的输出。

3. 权重共享

在RNN中,权重参数是共享的,即每个时间步都使用相同的权重矩阵。这种权重共享机制可以确保不同时间步的数据都使用相同的模型进行处理,从而保持模型的参数数量相对较小。同时,权重共享也使得RNN能够处理任意长度的序列数据,因为无论序列长度如何变化,模型的结构和参数都保持不变。

4. 前向传播与反向传播

RNN的前向传播过程是按照时间步的顺序逐步进行的。在每个时间步,根据当前的输入和前一时间步的隐藏状态计算出新的隐藏状态和输出。而反向传播过程则是为了更新模型的权重参数,以最小化损失函数。在反向传播过程中,需要计算损失函数关于每个时间步隐藏状态和权重的梯度,并使用这些梯度来更新权重参数。

二、RNN的结构分类

RNN可以根据其输入和输出的结构进行分类,常见的结构包括N to N、N to 1、1 to N和N to M等。

1. N to N

N to N结构的RNN输入和输出序列是等长的。这种结构适用于需要逐个元素进行处理的场景,如文本生成中的字符级生成。

2. N to 1

N to 1结构的RNN输入为一个序列,输出为一个单独的值。这种结构适用于需要对整个序列进行汇总或分类的场景,如文本分类任务。

3. 1 to N

1 to N结构的RNN输入不是一个序列,而是单个元素(或固定长度的向量),输出为一个序列。这种结构适用于需要根据单个输入生成序列输出的场景,如图像描述生成任务。

4. N to M

N to M结构的RNN不限制输入与输出的长度,由编码器和解码器两部分组成。这种结构也称为seq2seq结构,广泛应用于机器翻译、文本摘要等任务中。

三、RNN的优缺点

优点:

- 能够处理序列数据 :RNN通过其循环结构能够捕捉序列数据中的时序信息和上下文信息。

- 权重共享 :RNN中的权重参数是共享的,这有助于减少模型的参数数量并提高计算效率。

- 灵活性强 :RNN可以根据输入和输出的不同结构进行灵活调整,以适应不同的应用场景。

缺点:

- 梯度消失和梯度爆炸问题 :在长序列任务中,RNN容易出现梯度消失或梯度爆炸的问题,导致模型难以训练。

- 计算效率低 :由于RNN需要在每个时间步都进行前向传播和反向传播的计算,因此其计算效率相对较低。

- 模型复杂度较高 :虽然RNN的模型结构相对简单,但在处理复杂任务时可能需要构建较深的网络或引入额外的机制(如注意力机制)来提高性能。

四、RNN的改进模型

为了克服RNN的缺点并提高其性能,研究人员提出了多种改进模型,其中最具代表性的是LSTM(Long Short-Term Memory)和GRU(Gated Recurrent Unit)。

1. LSTM

LSTM是一种特殊的RNN模型,它通过引入遗忘门、输入门和输出门等结构来控制信息的传递和遗忘过程。LSTM能够有效地缓解梯度消失和梯度爆炸的问题,并在长序列任务中表现出色。

2. GRU

GRU是另一种简化的RNN模型,它在LSTM的基础上进行了改进,减少了模型的复杂度和计算量。GRU通过引入更新门和重置门等结构来控制信息的更新和重置过程,同样能够在一定程度上缓解梯度消失问题,并在保持较好性能的同时提高计算效率。

五、RNN的应用场景

RNN及其改进模型由于其处理序列数据的独特能力,在众多领域得到了广泛应用。

1. 自然语言处理(NLP)

- 文本生成 :RNN可以用于生成文本,如诗歌、文章、对话等。通过训练模型学习语言规则和模式,RNN能够生成符合语法和语义的文本序列。

- 机器翻译 :seq2seq结构的RNN(通常结合LSTM或GRU)在机器翻译任务中表现出色。模型能够理解源语言的句子,并生成目标语言的翻译结果。

- 情感分析 :RNN可以用于分析文本中的情感倾向,如正面、负面或中性。这对于社交媒体分析、产品评论等场景非常有用。

- 语音识别 :RNN能够将语音信号转换为文本序列。结合深度学习技术,RNN能够识别不同语言和方言的语音输入。

2. 时间序列预测

RNN在处理时间序列数据方面表现出色,能够捕捉数据中的时间依赖性和周期性。因此,RNN被广泛应用于股票价格预测、天气预测、交通流量预测等领域。

3. 音乐和音频生成

RNN可以学习音乐或音频数据的模式,并生成新的音乐作品或音频片段。这种能力使得RNN在音乐创作、音频效果生成等方面具有广泛的应用前景。

4. 图像处理

虽然RNN通常不直接用于图像处理(因为CNN在处理图像数据方面更为有效),但RNN在处理图像序列(如视频帧)或图像描述生成等任务中仍然具有一定的应用价值。

六、RNN的未来发展方向

随着深度学习技术的不断发展,RNN及其改进模型也在不断演进和拓展。以下是一些可能的未来发展方向:

- 结合其他深度学习模型 :RNN可以与其他深度学习模型(如CNN、Transformer等)结合使用,以充分利用各自的优势。例如,在图像描述生成任务中,可以先使用CNN提取图像特征,然后使用RNN生成描述文本。

- 优化训练算法 :针对RNN在训练过程中容易出现的梯度消失和梯度爆炸问题,研究人员正在探索更加有效的训练算法和正则化技术。这些技术有助于提高模型的稳定性和泛化能力。

- 应用于更多领域 :随着技术的不断进步和应用场景的不断拓展,RNN及其改进模型有望在更多领域得到应用。例如,在医疗领域,RNN可以用于分析病历数据、预测疾病进展等;在金融领域,RNN可以用于分析市场趋势、预测股票价格等。

七、结论

RNN作为一种专门用于处理序列数据的神经网络结构,在自然语言处理、时间序列预测、音乐和音频生成等领域展现出了强大的能力。尽管RNN存在梯度消失和梯度爆炸等问题,但通过引入LSTM、GRU等改进模型以及优化训练算法等技术手段,这些问题在一定程度上得到了缓解。未来,随着深度学习技术的不断发展和应用场景的不断拓展,RNN及其改进模型有望在更多领域发挥重要作用。

-

循环神经网络

+关注

关注

0文章

38浏览量

2967 -

自然语言处理

+关注

关注

1文章

618浏览量

13550 -

rnn

+关注

关注

0文章

89浏览量

6886

发布评论请先 登录

相关推荐

什么是RNN (循环神经网络)?

递归神经网络(RNN)

循环神经网络(RNN)和(LSTM)初学者指南

神经网络中最经典的RNN模型介绍

什么是RNN(循环神经网络)?RNN的基本原理和优缺点

什么是RNN(循环神经网络)?RNN的基本原理和优缺点

评论