案例简介

丽蟾科技通过 Leaper 资源管理平台集成 NVIDIA AI Enterprise,为企业和科研机构提供了一套高效、灵活的 AI 训练与推理加速解决方案。无论是在复杂的 AI 开发任务中,还是在高并发推理场景下,都能够确保项目的顺利进行,并显著提升业务效率与创新能力。

企业级 AI 软件套件

——NVIDIA AI Enterprise

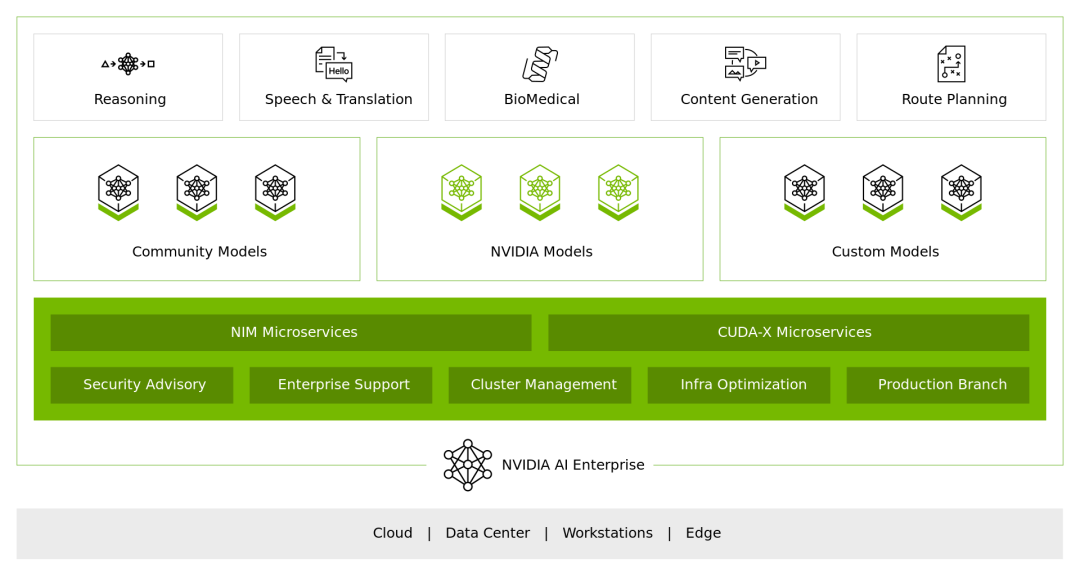

NVIDIA AI Enterprise是 NVIDIA 推出的一套完整的企业级 AI 软件套件,专为简化和加速 AI 开发与部署设计,帮助用户在多云环境、数据中心和边缘设备上高效运行人工智能工作负载。

图 1. NVIDIA AI Enterprise 端到端云原生软件平台

它提供了广泛的工具集与预训练模型,涵盖数据准备、模型训练、推理优化等各个环节,利用 NVIDIA 的 GPU 硬件加速器,为广泛的 AI 应用提供强大支持,从而加快企业和科研机构在 AI 领域的创新进程。作为一个全面的 AI 开发平台,集成了 NVIDIA 的多种技术,包括CUDA并行计算架构、cuDNN深度学习库、TensorRT推理加速引擎,以及NVIDIA Triton 推理服务器等。此外,NVIDIA AI Enterprise 为用户提供了丰富的预训练模型和工具集,支持主流的 AI 框架如 TensorFlow、PyTorch、MXNet 等,确保开发者可以利用熟悉的工具和框架高效工作。

丽蟾云 Leaper 集成 NVIDIA 软件堆栈

及计算参考架构,提供智算云解决方案

Leaper 是丽蟾科技自主研发的资源调度管理平台,可对 GPU 计算资源进行统一管理和调度,提供高性能的算力支撑,充分提高资源的利用率,且可为用户提供高效、灵活的 AI 应用研发与部署环境,用户可以轻松地创建和管理容器化的应用程序。

图 2.Leaper 主要功能模块

(本图来源于丽蟾科技,若您需要使用本图片或有任何疑问,请联系丽蟾科技)

丽蟾科技在智算云管理平台 Leaper 上深度集成了 NVIDIA AI Enterprise,为用户提供从数据准备、模型训练到推理部署的全面加速支持,并提供高效的 AI 训练与推理解决方案,通过与 NVIDIA AI Enterprise 的结合,用户可以享受无缝衔接的资源调度与 AI 加速服务。

图 3.Leaper 整体解决方案架构

(本图来源于丽蟾科技,若您需要使用本图片或有任何疑问,请联系丽蟾科技)

分布式训练支持与资源调度

Leaper 支持在大规模 GPU 集群环境下进行分布式训练,结合 NVIDIA AI Enterprise 及NVIDIA NCCL优化通信库,确保了大规模分布式训练的计算与通信效率,动态调度资源确保训练任务顺利进行。

自动混合精度训练,

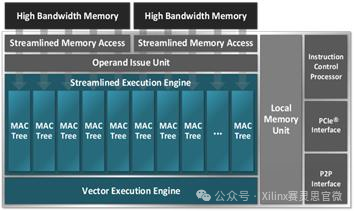

FP8 训练与推理优化

NVIDIA AI Enterprise 提供自动混合精度训练(AMP)功能,结合 Leaper 平台可以有效提高计算效率,在保持模型的精度的情况下加速 AI 训练过程,结合 NVIDIA Hopper 架构的 FP8 精度的计算能力,特别在推理方向,提供更高的推理性能,更低的延时响应,更高效的显存容量及带宽的使用效率,最终帮助大模型的推理性价比进一步提升和优化。

预训练模型、AI 算法框架与加速库

NVIDIA AI Enterprise 提供了丰富的预训练模型、AI 算法框架与加速库(如 TensorRT、cuDNN 和 PyTorch),Leaper 集成 NVIDIA AI Enterprise 能够充分发挥这些工具的性能,使用户能够直接在 Leaper 上快速部署这些模型,加速推理,更快完成训练任务。

实时监控与动态调度

通过 Leaper,用户可以实时监控训练进展,并根据需求动态调整资源调度,无论是训练中的资源分配,还是推理中的计算负载,都能确保高效利用 GPU 集群,避免资源浪费。

数据预处理加速

NVIDIA AI Enterprise 与RAPIDS框架的结合,在 GPU 上加速了数据预处理和特征工程环节。通过 Leaper,用户可以高效完成数据准备,缩短训练前期的时间成本。

为开发者打造快速、安全、

高性能的 AI 推理微服务

NVIDIA NIM是 NVIDIA AI Enterprise 的一部分,是一套易于使用的预构建容器工具,目的是帮助企业加速生成式 AI 的部署。它支持各种 AI 模型,可确保利用行业标准 API 在本地或云端进行无缝、可扩展的 AI 推理。Leaper 已经全面整合 NVIDIA NIM,覆盖了包括语音 AI、数据检索(RAG)、数字生物学、数字人、大语言模型(LLM)等领域。在 Leaper上,作为优化容器提供,旨在加速各种规模的企业的 AI 应用开发,为 AI 技术的快速生产和部署铺平道路。

通过 Leaper 内的 NVIDIA NIM,AI 开发者可以:

快速部署 AI 模型:NVIDIA NIM 允许组织利用预训练的 AI 模型,这些模型已经过优化,可以快速部署,减少了开发和训练新模型所需的时间和成本,在几分钟内跨各种环境部署 AI 应用程序,显著提高了生产力。

简化 AI 应用创建:通过 Leaper,集成了众多跨领域的专用微服务,包括 NVIDIA NIM 及定制化的 AI 模型,极大地简化了创建复杂 AI 应用的过程。无需从头开始构建 AI 模型,从而节省了宝贵的时间和资源。

跨领域集成:可以跨多个领域集成,例如,结合语音识别和大语言模型,创建能够提供个性化客户服务的数字人。

加速业务转型:使用 NVIDIA NIM,团队可以专注于将预训练的 AI 模型快速集成到现有的工作流程中,加速业务运营的数字化转型。

总体而言,Leaper 提供了经过优化,可以快速部署的预训练 AI 模型,也为 AI 从业者提供了一种快速、灵活且高效的方式来开发和部署 AI 应用,使他们能够更快地响应市场变化和客户需求,从而推动业务创新和增长。

为企业与科研机构

提供定制化的专业解决方案

丽蟾科技通过整合 Leaper 与 NVIDIA AI Enterprise,为多个行业提供了强大的 AI 开发与推理加速支持。以下是几个典型的应用场景:

科学研究

在处理大规模数据集的科学研究领域,如天体物理、化学模生物信息学等,Leaper 与 NVIDIA AI Enterprise 的高性能计算资源为科研人员提供了强大的支持,比如,Leaper 结合 RAPIDS 开源软件库,提供了 GPU 加速的数据科学工作流,更快地处理大规模数据集,进行科学探索与创新。

医疗领域

在医疗图像分析中,Leaper 与 NVIDIA AI Enterprise 的集成可以为医疗机构提供高效的 AI 模型训练与推理支持。医疗科研人员可以在 Leaper 平台上快速训练和部署 AI 模型,从而提高疾病诊断的准确性与效率,优化治疗效果。

能源行业

能源行业中的天气预测需要高效的计算资源。借助 Leaper 和 NVIDIA AI Enterprise 的结合,能源企业可以利用 GPU 加速天气预测模型的训练与推理,快速部署 AI 模型进行精准天气预测,优化能源分配与生产。

制造业

制造企业可以通过 Leaper 平台快速部署基于 NVIDIA AI Enterprise 的智能检测系统。NVIDIA AI Enterprise 的预训练模型和推理加速库帮助企业快速开发高效的质量检测模型,实现对产品质量的实时监控和分析,从而提高生产线的效率。

零售与电子商务

在零售行业,AI 技术已经广泛应用于推荐系统、客户行为分析等方面。通过 Leaper 平台,零售企业可以快速构建并部署基于 AI 的推荐引擎,从而为客户提供个性化的购物体验。NVIDIA AI Enterprise 提供的 AI 加速库和预训练模型能够帮助企业优化其推荐算法,提高客户转化率。

Leaper 实现 AI 训练与推理加速

上海丽蟾科技有限公司董事长吴敏华表示:“NVIDIA AI Enterprise 是一套端到端的完整的 AI 工具套件,在服务客户的过程中,我们发现该套件非常适合运行在云的环境中,通过丽蟾自研的 Leaper 云平台,将 NVIDIA 最先进的 AI 能力集成并传递给每一位客户。”

随着 AI 技术的不断发展,丽蟾科技将继续通过这一集成平台推动更多行业的技术进步与应用落地。

-

NVIDIA

+关注

关注

14文章

4978浏览量

102982 -

软件

+关注

关注

69文章

4921浏览量

87392 -

AI

+关注

关注

87文章

30728浏览量

268874

原文标题:NVIDIA AI Enterprise 助力丽蟾云 Leaper 打造高效 AI 训练与推理加速平台

文章出处:【微信号:NVIDIA-Enterprise,微信公众号:NVIDIA英伟达企业解决方案】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

赖耶科技通过NVIDIA AI Enterprise平台打造超级AI工厂

NVIDIA助力Amdocs打造生成式AI智能体

NVIDIA助力Figure发布新一代对话式人形机器人

NVIDIA与思科合作打造企业级生成式AI基础设施

AMD助力HyperAccel开发全新AI推理服务器

摩尔线程携手东华软件完成AI大模型推理测试与适配

英伟达推出全新NVIDIA AI Foundry服务和NVIDIA NIM推理微服务

NVIDIA加速计算和 AI助力数字银行揭穿金融欺诈骗局

HPE 携手 NVIDIA 推出 NVIDIA AI Computing by HPE,加速生成式 AI 变革

NVIDIA推出NVIDIA AI Computing by HPE加速生成式 AI 变革

进一步解读英伟达 Blackwell 架构、NVlink及GB200 超级芯片

AI推理,和训练有什么不同?

NVIDIA助力丽蟾科技打造AI训练与推理加速解决方案

NVIDIA助力丽蟾科技打造AI训练与推理加速解决方案

评论