在生成式 AI 时代,加速网络对于为大规模分布式 AI 工作负载构建高性能计算平台至关重要。NVIDIA 在加速网络领域继续保持领先地位,提供先进的以太网和 InfiniBand 解决方案,可最大限度地提高 AI 工厂和云数据中心的性能和效率。

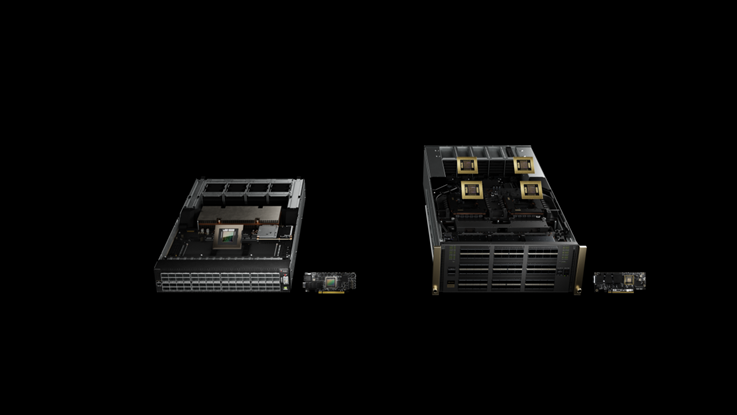

这些解决方案的核心是NVIDIA SuperNIC,一种专为超大规模 AI 工作负载而优化的新型网络加速器。这些 SuperNIC 是NVIDIA Spectrum-X 以太网和Quantum-X800 InfiniBand 网络平台的关键组件,旨在提供前所未有的可扩展性和性能。

ConnectX-8 SuperNIC 是 NVIDIA SuperNIC 产品系列中的新成员,与 BlueField-3 SuperNIC 一起,共同推动加速的大规模 AI 计算网络的新一轮创新浪潮。ConnectX-8 SuperNIC 的总数据吞吐量为 800 Gb/s,可为万亿级参数的 AI 模型提供所需的速度、网络健壮性和可扩展性,并与 NVIDIA 交换机无缝集成,以实现最佳性能。

本文将探讨 NVIDIA SuperNIC 的独特属性及其在推进现代 AI 基础设施发展方面的关键作用。

RoCE 对于 AI 工作负载的重要性

对于 AI 模型训练来说,在数据中心内的 GPU 之间高速传输庞大的数据集是 AI 方案缩短训练时间和加快上市时间的关键。

NVIDIA SuperNIC 具备了出色的硬件 RoCE 加速功能,可实现高达 800 Gb/s 的 GPUDirect RDMA 通信速度,解决了旁路 CPU 在 GPU 之间实现直接数据传输面临的挑战。

这种直接通信的方法可最大限度地减少 CPU 开销并降低延迟,在 GPU 显存之间实现更快、更高效的数据传输。在实际应用中,此功能可实现更高的并行度,在 AI 工作负载多节点扩展时,不会出现传统的基于 CPU 的数据传输常见的的通信瓶颈。

通过 Spectrum-X RoCE 动态路由

提升 AI 性能

NVIDIA SuperNIC 的直接数据放置(DDP)功能是 Spectrum-X 平台提升 AI 网络性能的关键之一。

随着生成式 AI 工作负载扩展到了数千个节点以上,以等价多路径(ECMP)为代表的传统 IP 路由协议再难以处理 AI 模型生成的大规模、持续的数据流(俗称大象流)。这些流可能会使网络资源不堪重负,并导致拥塞,从而降低整体网络性能。

Spectrum-X RoCE 动态路由可以在可用的网络路径中动态调整流量的分配,确保需要高带宽的流以最佳方式路由,以防止网络拥塞。该方法利用 NVIDIA Spectrum-4 以太网交换机可在多个路径上均匀分发数据包的负载均衡功能,避免了传统静态路由机制造成的瓶颈。

然而,使用这样的数据包分发的方式,可能会导致数据包乱序问题的出现。

NVIDIA SuperNIC 通过在数据包到达接收端时将其直接按序放入缓冲区来解决了这一问题,确保了应用能收到正确顺序的数据。这种 NVIDIA 交换机和 SuperNIC 之间的紧密合作,实现了高效、高速的 AI 工作负载通信,确保大规模 AI 模型能够持续地处理数据,而不会中断或降低性能。

解决 AI 网络的拥塞问题

由于 AI 工作负载的突发性,因此极易受到网络拥塞的影响。AI 模型训练(尤其是通过集合通信在多个 GPU 之间进行同步和共享数据时)会产生频繁且短暂流量峰值,这需要先进的拥塞管理机制来保持网络的性能。传统的拥塞控制方法(例如基于 TCP 的流量控制)无法处理这种 AI 独特的流量模型。

为了解决这一问题,Spectrum-X 采用了基于 Spectrum-4 交换机的实时遥测功能的先进拥塞控制机制,使得 SuperNIC 能够根据当前的网络利用率主动地调整数据发送的速率,防止拥塞,避免问题的发生。

通过使用带内高频遥测数据,SuperNIC 可以以微秒级精度作出反应,确保即使在高流量条件下也能优化网络带宽并尽可能降低延迟。

使用增强的可编程 I/O 加速 AI 网络

随着 AI 工作负载日益复杂,网络基础设施不仅必须在速度上不断发展,还需要在适应性方面进步,以支持数千个节点之间的各种通信模式。

NVIDIA SuperNIC 处于这项创新的前沿,提供增强的可编程 I/O 功能,这些功能对于现代 AI 数据中心环境至关重要。这些 SuperNIC 具有加速数据包处理管线,能够以线速运行,吞吐量高达 800 Gb/s。

通过将数据包处理任务从 CPU 卸载到 SuperNIC,此管道可显著降低网络延迟并提高整体系统效率。管道的可编程性由 NVIDIA DOCA 软件框架提供支持,为网络专业人员提供了大规模构建和优化网络的灵活性。

NVIDIA SuperNIC 采用数据路径加速器(DPA),可增强可编程性。DPA 是一种高度并行的 I/O 处理器,配备 16 个超线程核心,专为处理 I/O 密集型工作负载而设计。它可以通过 DOCA 针对设备仿真、拥塞控制和流量管理等各种低代码应用程序轻松进行编程。这种可编程性使组织能够根据其 AI 工作负载的特定需求定制网络基础设施,确保数据在保持峰值性能的同时跨网络高效流动。

保护 AI 网络连接

保护 AI 模型对于保护敏感数据和知识产权免遭潜在的漏洞和对抗性攻击至关重要。当您的组织构建 AI 工厂和云数据中心时,您需要有效的安全解决方案来解决可能损害模型性能和可信度的漏洞,最终保护竞争优势和用户隐私。

传统的网络加密方法通常难以扩展到 100 Gb/s 以上,从而使关键数据处于危险之中。相比之下,NVIDIA SuperNIC 可提供加速网络和在线加密加速,速度高达 800 Gb/s,确保数据在传输过程中保持加密状态,同时实现峰值 AI 性能。

NVIDIA SuperNIC 为 IPsec、TLS 和可扩展的 PSP 加密操作提供硬件加速支持,为保护人工智能网络环境提供成熟的解决方案。

PSP 由 Google 开发,并为开源社区做出了贡献。PSP 从一开始就采用无状态设计,非常适合支持超大规模数据中心环境的需求。该架构允许独立处理每个请求,从而增强在分布式系统中管理加密操作的可扩展性和弹性。

结束语

在生成式 AI 的动态格局中,NVIDIA SuperNIC 作为 NVIDIA Spectrum-X 和 Quantum-X800 网络平台不可或缺的一部分,为网络的变革时代奠定了基础。

-

NVIDIA

+关注

关注

14文章

4978浏览量

102981 -

网络

+关注

关注

14文章

7553浏览量

88724 -

AI

+关注

关注

87文章

30728浏览量

268871

原文标题:NVIDIA SuperNIC 驱动新一代 AI 网络发展

文章出处:【微信号:NVIDIA-Enterprise,微信公众号:NVIDIA英伟达企业解决方案】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

NVIDIA AI正加速推进药物研发

英伟达与信实集团携手在印度建设AI基础设施

NVIDIA助力印度打造AI基础设施

智能驾驶所需的基础设施

NVIDIA与思科合作打造企业级生成式AI基础设施

微软贝莱德成立AI基础设施投资基金

Sam Altman的全球AI基础设施建设计划加速推进

借助NVIDIA DOCA 2.7增强AI 云数据中心和NVIDIA Spectrum-X

微软在东南亚大举投资AI基础设施

垂直起降机场:飞行基础设施的未来是绿色的

英伟达拟将收购AI基础设施虚拟化初创企业Run:ai

NVIDIA 发布全新交换机,全面优化万亿参数级 GPU 计算和 AI 基础设施

NVIDIA SuperNIC推进现代AI基础设施发展

NVIDIA SuperNIC推进现代AI基础设施发展

评论