FAIR何恺明团队最新论文提出“全景FPN”,聚焦于图像的全景分割任务,将分别用于语义分割和实例分割的FCN和Mask R-CNN结合起来,设计了PanopticFPN。该方法可能成为全景分割研究的强大基线。

Facebook人工智能实验室(FAIR)何恺明等人团队在arXiv发布最新论文:Panoptic Feature Pyramid Networks。

论文聚焦于“全景分割”,在架构级别将分别用于语义分割和实例分割的FCN和Mask R-CNN结合起来,设计了一个单一的网络:Panoptic FPN。

作者表示,实验证明Panoptic FPN对语义分割和实例分割这两个任务都有效,同时兼具稳健性和准确性。鉴于其有效性和概念的简单性,该方法有望成为一个强大的baseline,成为全景分割后续进展的基础。

虽然在概念上很简单,但设计一个在这两个任务都能实现高精度的单一网络是具有挑战性的,因为这两个任务的最佳性能方法存在许多差异。

Panoptic FPN在COCO和Cityscapes上的结果

对于语义分割,通过扩张卷积(dilated convolutions)增强的FCN是最优的。对于实例分割,具有特征金字塔(FPN)骨架的region-based Mask R-CNN在最近的图像识别竞赛中被用作所有高分网络的基础。

考虑到这些方法在架构上的差异,在为这两个任务设计单个网络时,可能需要在实例分割或语义分割上牺牲准确性。但是,FAIR团队提出一种简单、灵活且有效的架构,可以使用一个同时生成region-based输出(实例分割)和dense-pixel输出(语义分割)的单一网络来保证这两个任务的准确性。

在对每个任务单独进行训练时,该方法在COCO和Cityscapes上的实例分割和语义分割都取得了很好的效果。实例分割接近Mask R-CNN,语义分割的精度与最新的DeepLabV3+相当。

接下来,我们将具体介绍Panoptic FPN的架构和实验结果。

全景特征金字塔网络Panoptic FPN

Panoptic FPN是一个简单的、单网络的baseline,它的目标是在实例分割和语义分割以及它们的联合任务:全景分割上实现最高性能。

设计原则是:从具有FPN的Mask R-CNN开始,进行最小的修改,生成一个语义分割的dense-pixel 输出(如图1所示)。

模型架构

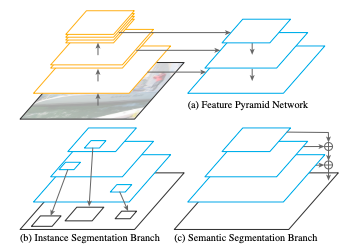

图1:Panoptic FPN的架构

(a)特征金字塔网络 (b)实例分割分支 (c)语义分割分支

特征金字塔网络(Feature Pyramid Network):首先简要回顾一下FPN。FPN采用一个具有多空间分辨率特征的标准网络(如ResNet),并添加一个具有横向连接的自上而下的通道,如图1a所示。自上而下的路径从网络的最深层开始,并逐步向上采样,同时添加自底向上路径的高分辨率特性的转换版本。FPN生成一个金字塔,通常具有1/32到1/4的分辨率,其中每个金字塔级别具有相同的通道维度(默认是256)。

实例分割分支:FPN的设计,特别是对所有金字塔级别使用相同的通道维数,使得附加基于区域的对象检测器变得很容易,比如Faster R-CNN。 为了输出实例分段,我们使用Mask R-CNN,它通过添加FCN分支来预测每个候选区域的二进制分段Mask,从而扩展Faster R-CNN,见图1b。

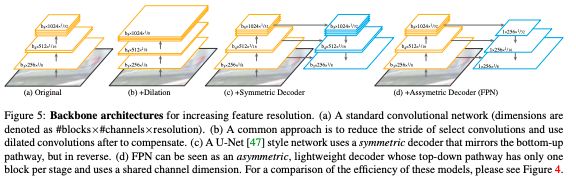

用于增加特征分辨率的骨架架构

Panoptic FPN:如前所述,我们的方法是使用FPN对Mask R-CNN进行修改,实现像素级语义分割预测。然而,为了实现准确的预测,该任务所使用的特性应该:

(1)具有适当的高分辨率,以捕获精细的结构;

(2)编码足够丰富的语义,以准确地预测类标签;

(3)虽然FPN是为目标检测而设计的,但是这些要求——高分辨率、丰富的、多尺度的特征——正好是FPN的特征。

因此,我们建议在FPN上附加一个简单而快速的语义分割分支。

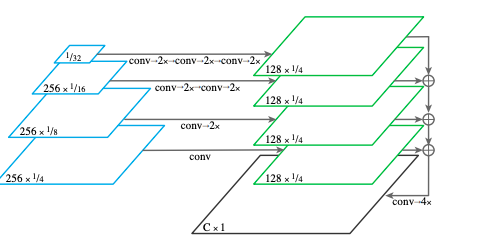

图3:语义分割分支

实验和结果

我们的目标是证明我们的方法,Panoptic FPN,可以作为一个简单有效的单网络baseline,用于实例分割、语义分割,以及他们的联合任务全景分割。

因此,我们从测试语义分割方法(我们将这个单任务变体称为Semantic FPN)开始分析。令人惊讶的是,这个简单的模型在COCO和Cityscapes数据集上实现了具有竞争力的语义分割结果。

接下来,我们分析了语义分割分支与Mask R-CNN的集成,以及联合训练的效果。最后,我们再次在COCO和Cityscapes数据集上展示了全景分割的结果。定性结果如表2和表6所示。

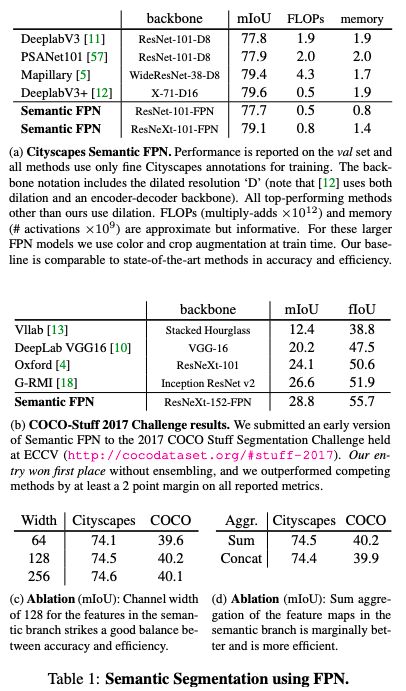

语义分割FPN

表1:语义分割FPN的结果

Cityscapes数据集:

我们首先将基线Semantic FPN与表1a中Cityscapes数据集上语义分割的现有方法进行比较。我们的方法是FPN的一个最小扩展,与DeepLabV3+[12]等经过大量工程设计的系统相比,我们的方法能够获得强大的结果。

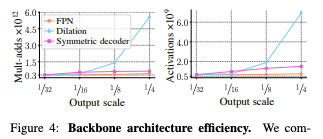

在我们的基线中,我们故意避免正交的架构改进,如Non-local或SE,这可能会产生进一步的收益。在计算和内存方面,Semantic FPN比典型的dilation model更轻量,同时能产生更高的分辨率特征(见图4)。

图4

COCO数据集:

我们的方法的一个早期版本赢得了2017年的COCO-Stuff 挑战。结果见表1b。

多任务训练

我们的方法在单任务上表现非常好;对于语义分割,上一节的结果证明了这一点;对于实例分割,这是已知的,因为该方法基于Mask R-CNN。但是,我们是否可以在多任务环境中共同训练这两项任务呢?

为了将我们的语义分割分支与Mask R-CNN中的实例分割分支结合起来,我们需要确定如何训练一个单一的、统一的网络。以往的研究表明,多任务训练往往具有挑战性,并可能导致结果精度下降。我们同样观察到,对于语义或实例分割,添加辅助任务与单任务基线相比会降低准确性。

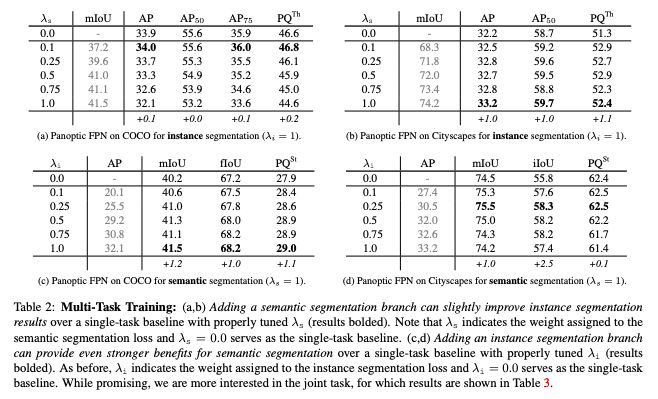

表2:多任务训练

表2中,ResNet-50-FPN的结果表明,使用一个简单的语义分割损失λs,或实例分割损失λi,结果可以改善单任务baseline的结果。具体来说,适当地添加一个语义分割分支λs能改进实例分割,反之亦然。这可以用来改进单任务结果。然而,我们的主要目标是同时解决这两个任务,这将在下一节讨论。

Panoptic FPN

测试Panoptic FPN对于全景分割的联合任务的结果,其中网络必须联合并准确的输出 stuff和thing分割。

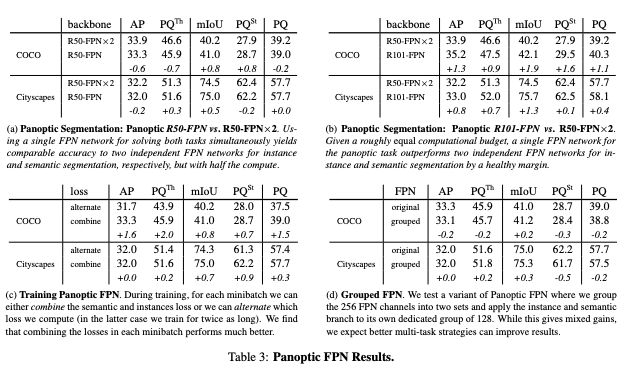

表3:Panoptic FPN的结果

主要结果:在表3a中,我们比较了使用相同骨架的Panoptic FPN分别训练的两个网络。Panoptic FPN具有相当的性能,但只需要一半的计算量。

我们还通过比较两个单独的网络,分别是Panoptic R101-FPN 和 R50-FPN×2,来平衡计算预算,见表3b。使用大致相等的计算预算,Panoptic FPN明显优于两个独立的网络。

综上所述,这些结果表明联合方法是有益的,我们提出的Panoptic FPN方法可以作为联合任务的可靠baseline。

- 图像识别

+关注

关注

8文章

511浏览量

38106 - 分割

+关注

关注

0文章

17浏览量

11874

原文标题:何恺明组又出神作!最新论文提出全景分割新方法

文章出处:【微信号:AI_era,微信公众号:新智元】欢迎添加关注!文章转载请注明出处。

发布评论请先登录

相关推荐

labview全景图像拼接

全景监控摄像机四大特性

高速球的完美结合 鱼眼全景的发展方向

【MiCOKit申请】360度全景泊车系统

【OK210申请】汽车全景系统设计

如何在FPGA上实时展开全景图像?

基于RK3588的360°全景相机

基于全景图像的拼接算法研究

聚焦语义分割任务,如何用卷积神经网络处理语义图像分割?

FAIR何恺明、Ross等人最新提出实例分割的通用框架TensorMask

Facebook AI使用单一神经网络架构来同时完成实例分割和语义分割

FAIR何恺明团队最新论文提出“全景FPN”,聚焦于图像的全景分割任务

FAIR何恺明团队最新论文提出“全景FPN”,聚焦于图像的全景分割任务

评论